AI検索は私たちの情報収集を大きく変えつつあります。しかし、AIが生成する回答には「ハルシネーション」と呼ばれる重大な問題が潜んでいます。ハルシネーションとは、AIがもっともらしいが事実とは異なる情報を生成してしまう現象のことです。AI検索を活用するビジネスパーソンや情報発信者にとって、この問題を正しく理解し対策を講じることは欠かせません。本記事では、AI検索におけるハルシネーションの基本的な仕組みから発生原因、具体的な対策方法までをわかりやすく解説します。正確な情報活用のために、ぜひ最後までご覧ください。

- AI検索のハルシネーションが起こる仕組みと原因

ハルシネーションは、AIの学習データの偏りや統計的な文章生成の仕組みに起因して発生します。

- ハルシネーションの代表的な種類と見分け方

事実と異なる情報の捏造や、文脈のずれた回答など、複数のパターンを知ることで誤情報を見抜けるようになります。

- 今すぐ実践できるハルシネーション対策

プロンプト設計の工夫やファクトチェックの習慣化など、個人でもすぐに取り組める具体的な方法があります。

AI検索のハルシネーションとは

ハルシネーションの定義

ハルシネーションとは、生成AIが学習データに存在しない情報や事実と異なる内容を、もっともらしく出力する現象を指します。NRIセキュアテクノロジーズの定義によると、大規模言語モデル(LLM)が事実に基づかない情報を生成する問題として位置づけられています。

この現象は単なる「間違い」とは異なります。AIが自信を持って述べるため、受け手側が疑いを持ちにくいという特徴があります。人間の専門家が誤った情報を堂々と述べるような状態に近いといえるでしょう。

なぜ「幻覚」と呼ばれるのか

「ハルシネーション」という名称は、人間が実際には存在しないものを知覚する「幻覚」に由来しています。AIが実在しないデータや事実を、あたかも存在するかのように「知覚」して出力する様子が幻覚症状と類似しているためです。

AIには「嘘をつく意図」はなく、統計的に最もそれらしい文章を生成しているに過ぎません。しかし結果として、架空の論文名を引用したり、存在しない統計データを提示したりする現象が起きてしまうのです。

AI検索で特に問題になる理由

従来の検索エンジンは、既存のWebページへのリンクを提示する仕組みでした。一方、AI検索は情報を要約・統合して直接回答を生成するため、利用者が情報の出典を確認しにくくなっています。

この構造的な違いにより、AI検索ではハルシネーションの影響がより深刻になります。利用者は提示された回答をそのまま受け入れやすく、誤情報が意思決定や業務に直結してしまうリスクがあるのです。

以下の表は、従来の検索エンジンとAI検索の違いをまとめたものです。

| 項目 | 従来の検索エンジン | AI検索 |

|---|---|---|

| 回答形式 | Webページのリンク一覧 | 要約・統合された直接回答 |

| 出典の確認しやすさ | リンク先で確認可能 | 出典が不明瞭な場合がある |

| ハルシネーションリスク | 低い(既存ページを表示) | 高い(情報を生成する) |

| 利用者の検証負担 | 比較的小さい | 大きい |

このように、AI検索の利便性が高まるほど、ハルシネーションへの注意がより重要になってきます。

AI検索は便利ですが、出力された内容が正しいとは限らないことを常に意識しておきましょう。

ハルシネーションが発生する原因

学習データの偏りと不足

AIモデルは学習データに含まれる情報をもとに回答を生成するため、データに偏りや不足があるとハルシネーションが起こりやすくなります。特定分野のデータが少ない場合、AIは限られた情報から推測して回答を補完しようとします。

また、学習データに誤った情報が含まれていた場合、AIはその誤情報をそのまま学習してしまいます。結果として、間違いを正しい知識として出力する可能性があるのです。

大規模言語モデルの生成構造

大規模言語モデル(LLM)は、入力されたテキストに対して統計的に最も確率の高い次の単語を予測する仕組みで文章を生成しています。この仕組みは「もっともらしい文章」を作ることに長けていますが、内容の真偽を判断する能力は持っていません。

つまり、AIは「正しいから出力する」のではなく「自然に見えるから出力する」という構造的な特性を持っています。この特性こそが、ハルシネーション発生の根本的なメカニズムです。

プロンプトの曖昧さ

ユーザーがAIに入力する質問や指示(プロンプト)が曖昧だと、AIは意図を正しく解釈できずにハルシネーションを起こしやすくなります。条件が不明確なまま回答を求められたAIは、不足部分を推測で補うことがあるためです。

たとえば、「最近のデータを教えて」という質問では、「最近」がいつを指すのか不明確です。このような曖昧な指示が、誤った情報の生成につながることがあります。

情報の鮮度に関する限界

多くのAIモデルには学習データの期限(カットオフ)があり、最新の情報を持っていない場合があります。リアルタイム検索に対応していないAIに最新の出来事について質問すると、古い情報をもとにした不正確な回答や、存在しない情報を生成してしまう可能性があります。

この点は、時事的な話題や変化の速い業界の情報を扱う際に特に注意が必要です。

以下の表は、ハルシネーションの主な発生原因とその影響をまとめたものです。

| 発生原因 | 内容 | 影響の大きさ |

|---|---|---|

| 学習データの偏り | 特定分野のデータ不足や誤データの混入 | 高い |

| 生成構造の特性 | 確率的な文章生成で真偽判断ができない | 非常に高い |

| プロンプトの曖昧さ | 不明確な指示による推測補完 | 中程度 |

| 情報の鮮度制限 | 学習データのカットオフによる情報不足 | 中〜高 |

複数の原因が重なるほどハルシネーションの発生確率は高まるため、それぞれの要因を意識することが大切です。

原因を知っておけば、AIの回答のどこに注意すべきかが見えてきます。

AI検索パートナーズでは、

AIに”選ばれる”ための戦略設計から実行まで支援!

ハルシネーションの種類と具体例

事実の捏造型ハルシネーション

事実の捏造型は、実在しないデータ・人物・出来事をAIが「でっち上げる」タイプのハルシネーションです。架空の研究論文を引用したり、存在しない統計データを提示したりするケースがこれに当たります。

このタイプは非常に発見しにくく、専門知識がなければ誤りに気づけないことも少なくありません。特に学術的な情報やデータを求める場面では、出典を必ず確認する姿勢が求められます。

文脈のすり替え型ハルシネーション

文脈のすり替え型は、質問の意図とは異なる文脈で回答を生成してしまうタイプです。たとえば、ある分野の専門用語について質問したのに、別の分野での意味で説明されるケースが該当します。

文章としては正しく見えるため、質問者が十分な前提知識を持っていないと、回答のずれに気づかない危険性があります。

過度な一般化による誤情報

過度な一般化型は、限定的な事例や条件付きの情報を、あたかも普遍的な事実であるかのように述べてしまうタイプです。「すべての場合に当てはまる」かのような表現でAIが回答を出力することがあります。

実際には例外や条件があるにもかかわらず、断定的に記述されるため、利用者が情報の適用範囲を誤って理解するリスクがあります。

以下の表は、ハルシネーションの種類ごとの特徴と見分け方のポイントをまとめたものです。

| 種類 | 特徴 | 見分け方のポイント |

|---|---|---|

| 事実の捏造型 | 存在しない情報をもっともらしく提示 | 出典や引用元を必ず確認する |

| 文脈のすり替え型 | 質問意図と異なる文脈で回答 | 回答が質問に正確に対応しているか確認する |

| 過度な一般化型 | 限定的な事実を普遍的に述べる | 「すべて」「必ず」などの断定表現に注意する |

AIの回答を受け取る際には、これらのパターンを意識して内容を精査する習慣をつけることが重要です。

ハルシネーションを見抜くチェックポイント

- AIが引用した出典や参考文献が実在するか確認する

- 回答が質問の意図に正しく対応しているか読み返す

- 「すべて」「必ず」などの断定的な表現が含まれていないか注意する

- 複数の情報源で同じ内容が確認できるかクロスチェックする

ハルシネーションのパターンを知っておくだけで、AIの回答を見る目が変わってきますよ。

AI検索パートナーズでは、AIに”選ばれる”ための戦略設計から実行まで一気通貫で支援!

AI検索パートナーズでは、AI検索の専門知識と支援実績を持つ専任コンサルタントが、AIに“引用される・選ばれる”ための戦略設計からコンテンツ最適化、効果測定・改善まで一気通貫でご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

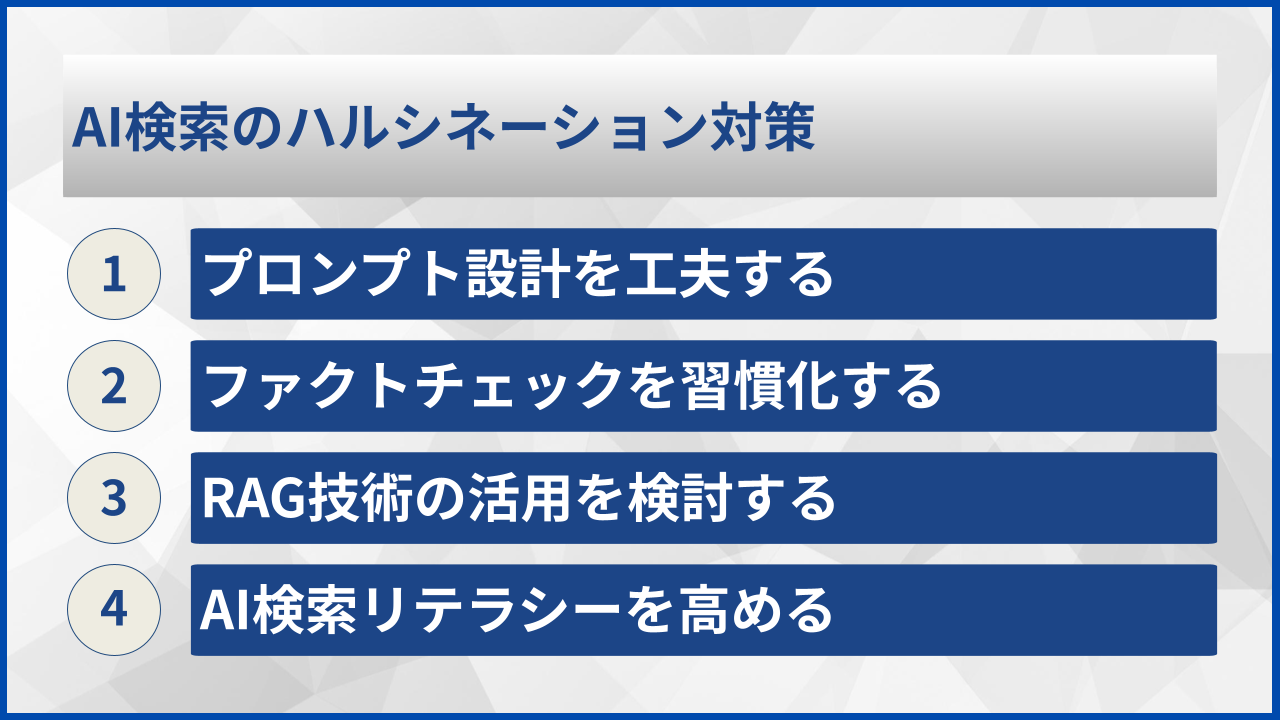

AI検索のハルシネーション対策

プロンプト設計を工夫する

AI検索でハルシネーションを減らすためには、具体的かつ明確なプロンプトを設計することが効果的です。質問の範囲を限定し、求める回答形式を指定することで、AIが推測で補完する余地を減らすことができます。

たとえば、「〇〇について教えて」ではなく「〇〇の△△に関する特徴を3つ箇条書きで教えて」のように具体化すると、より正確な回答を得やすくなります。条件や制約を明示することがポイントです。

ファクトチェックを習慣化する

AIの回答を鵜呑みにせず、必ず複数の情報源で事実確認を行う習慣を身につけることが重要です。特に数値データ、人名、年号、法律関連の情報などは、信頼できる一次情報で裏付けを取るようにしましょう。

ファクトチェックは手間に感じるかもしれませんが、誤情報に基づいた判断が招く損失と比較すれば、十分に価値のある作業です。

RAG技術の活用を検討する

RAG(Retrieval-Augmented Generation)とは、AIが回答を生成する際に外部の信頼できるデータベースから情報を検索・参照する技術です。この技術を組み込むことで、学習データに依存せず、最新かつ正確な情報をもとにした回答が可能になります。

RAGの導入は技術的なハードルがありますが、ビジネスでAI検索を本格的に活用する場合には有力な選択肢の一つといえるでしょう。

AI検索リテラシーを高める

最も根本的な対策は、AI検索に対するリテラシーを高めることです。AIは万能ではなく、間違いを犯す可能性があるという前提を持つことが、ハルシネーションによる被害を防ぐ第一歩となります。

組織でAI検索を利用する場合は、チーム全体でハルシネーションのリスクを共有し、チェック体制を整えておくことが望ましいでしょう。

今すぐ実践できるハルシネーション対策チェックリスト

- プロンプトに具体的な条件・制約を含める

- AIの回答に含まれる数値やデータは一次情報で確認する

- 重要な意思決定にAIの回答をそのまま使わない

- チーム内でAI検索の利用ルールとチェック体制を整える

以下の表は、対策方法ごとの難易度と効果をまとめたものです。取り組みやすいものから始めてみてください。

| 対策方法 | 実施の難易度 | ハルシネーション軽減効果 |

|---|---|---|

| プロンプト設計の工夫 | 低い | 中程度 |

| ファクトチェックの習慣化 | 低い | 高い |

| RAG技術の活用 | 高い | 非常に高い |

| AI検索リテラシーの向上 | 中程度 | 高い |

対策は一つだけに頼るのではなく、複数を組み合わせることでより高い効果が期待できます。

まずはプロンプトの工夫とファクトチェックから始めてみるのがおすすめです。

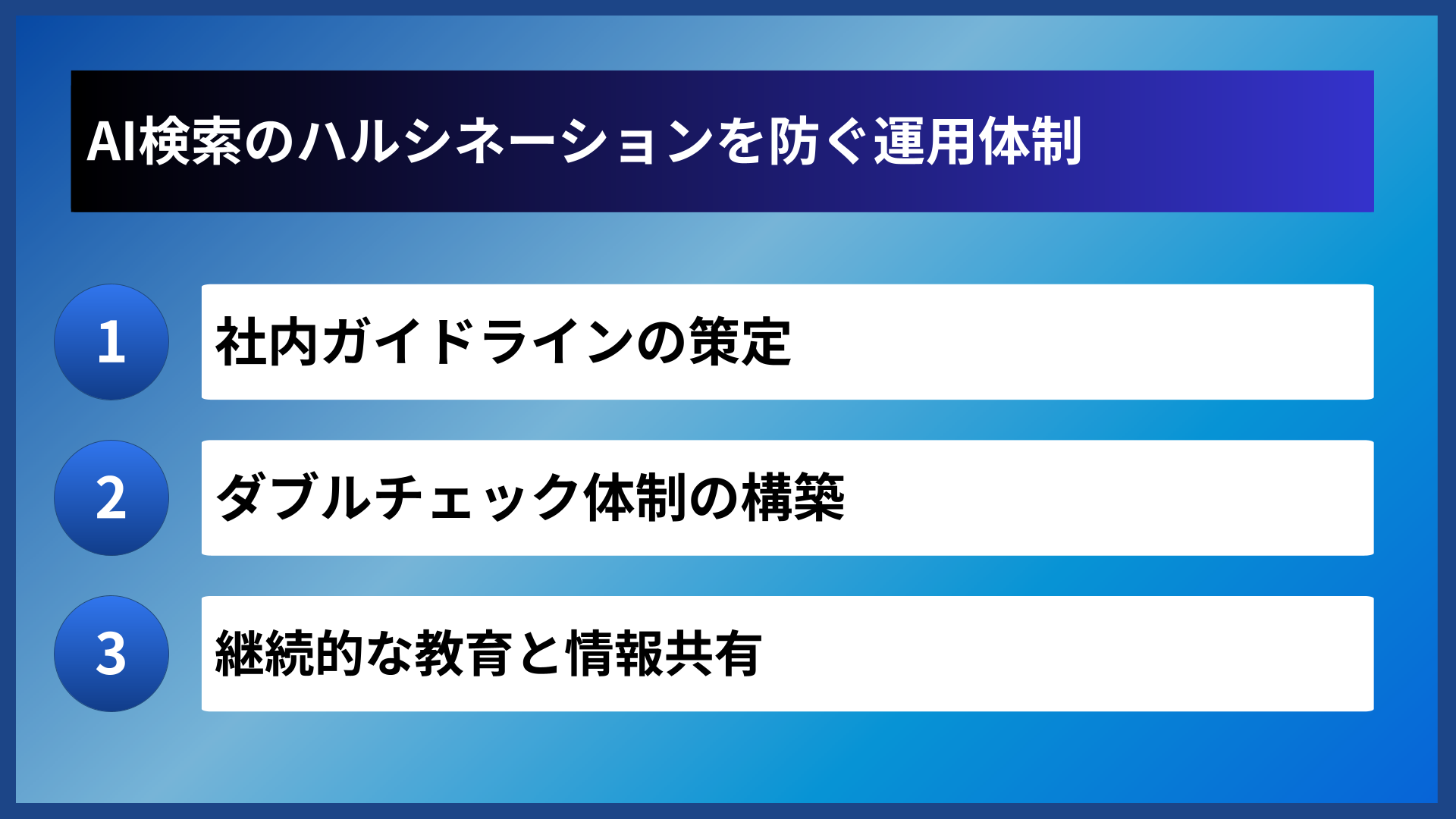

AI検索のハルシネーションを防ぐ運用体制

社内ガイドラインの策定

AI検索を業務に導入する際は、ハルシネーションのリスクを踏まえた社内ガイドラインを策定することが効果的です。利用目的の範囲、ファクトチェックの手順、責任の所在などを明文化しておくことで、組織全体で一定の品質を担保できます。

ガイドラインは一度作って終わりではなく、AI技術の進歩に合わせて定期的に見直すことが望ましいでしょう。

ダブルチェック体制の構築

AIが生成した情報を業務に活用する場合、人間によるダブルチェック体制を組み込むことが有効です。特に公開情報や顧客向け資料など、影響範囲が大きいコンテンツについては、複数人による確認プロセスを設けることをおすすめします。

AIの利便性を活かしつつ、最終判断は必ず人間が行うという原則を守ることで、ハルシネーションによるリスクを最小限に抑えることができます。

継続的な教育と情報共有

AI検索技術は急速に進化しており、ハルシネーションの傾向や対策方法も変化し続けています。組織内で定期的にAI活用に関する勉強会を開催したり、最新の事例やリスク情報を共有する仕組みを作ったりすることが重要です。

メンバー一人ひとりのAIリテラシーが向上すれば、組織全体としてハルシネーションへの耐性が自然と高まっていきます。

運用体制づくりのチェックリスト

- AI検索の利用範囲と禁止事項を明文化したガイドラインがある

- AI生成コンテンツに対する人間のダブルチェック体制がある

- AI検索に関する社内教育や情報共有の機会が定期的にある

- ガイドラインの定期見直しスケジュールが設定されている

個人の注意だけでなく、組織としての仕組みを整えることが長期的なリスク低減につながるでしょう。

よくある質問

- AI検索のハルシネーションは完全になくすことができますか?

-

現時点では、ハルシネーションを完全にゼロにすることは技術的に困難とされています。しかし、プロンプト設計の工夫、ファクトチェックの徹底、RAG技術の活用などを組み合わせることで、発生リスクを大幅に低減することは可能です。AI技術の進歩とともに、今後さらに精度は向上していくと考えられます。

- ハルシネーションが起きやすいのはどのような場面ですか?

-

最新の出来事や専門性の高い分野、具体的な数値データや固有名詞を含む質問でハルシネーションが起きやすい傾向があります。また、曖昧なプロンプトや広範囲な質問を投げかけた場合にも、AIが推測で回答を補完することで不正確な情報が生成されやすくなります。

- ビジネスでAI検索を活用する際に最低限やるべき対策は何ですか?

-

最低限の対策として、AIの回答を必ず複数の信頼できる情報源でファクトチェックすること、重要な意思決定にはAIの回答をそのまま使わないこと、そしてチーム内でAI検索の利用ルールを共有しておくことの3つが挙げられます。これらを実践するだけでも、ハルシネーションによるリスクを大きく減らせます。

まとめ

AI検索のハルシネーションとは、AIが事実に基づかない情報をもっともらしく生成してしまう現象です。学習データの偏り、大規模言語モデルの構造的な特性、プロンプトの曖昧さ、情報の鮮度制限など、複数の原因が組み合わさって発生します。

対策としては、プロンプト設計の工夫やファクトチェックの習慣化が今すぐ始められる方法です。組織で活用する場合には、ガイドラインの策定やダブルチェック体制の構築も検討してみてください。

AI検索は今後もますます普及していく技術です。ハルシネーションのリスクを正しく理解し、適切な対策を講じることで、AIの力を安全かつ効果的に活用していきましょう。