生成AIの普及にともない、Webサイト上のコンテンツがAIクローラーによって無断で学習データとして収集されるケースが増えています。自社の記事やデータを適切に守りながら、必要なAIプラットフォームには情報を届けたいと考えるサイト運営者にとって、AIボットディレクティブの理解と実装は避けて通れないテーマです。本記事では、AIボットディレクティブの基本的な仕組みから、robots.txtやメタタグを用いた具体的な制御方法、導入時の注意点までを体系的に解説します。自社コンテンツの保護と拡散を両立させるための実践的な知識を身につけましょう。

- AIボットディレクティブの基本概念と仕組み

AIボットディレクティブとは、AIクローラーに対してサイトのクロールやデータ収集の可否を指示する仕組みであり、robots.txtやメタタグなどで実装できます。

- 具体的な制御方法と設定手順

robots.txtでのUser-Agent指定やメタタグによるページ単位の制御など、目的に応じた複数の方法を使い分けることが効果的です。

- 導入時の注意点と運用のポイント

AIボットディレクティブの設定を誤ると検索エンジンのインデックスにも影響が出る可能性があるため、対象ボットの識別や定期的な見直しが重要です。

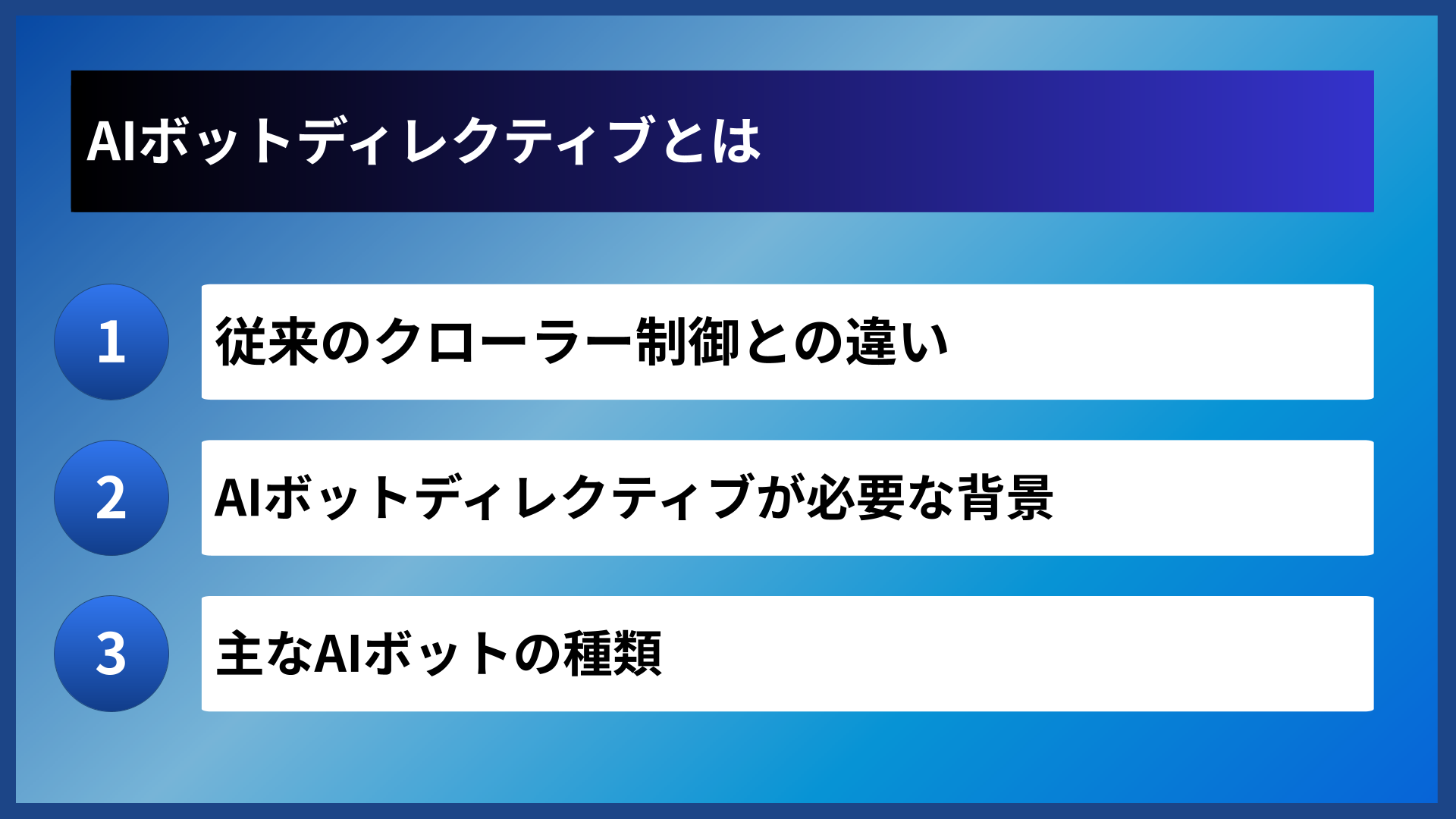

AIボットディレクティブとは

従来のクローラー制御との違い

AIボットディレクティブは、従来のrobots.txtによるクローラー制御を拡張し、AI専用のクローラーを個別に識別して制御する点が最大の特徴です。従来のクローラー制御は主にGooglebotやBingbotといった検索エンジン向けボットを対象としていました。一方、AIボットディレクティブではGPTBot、ClaudeBot、Google-Extendedなど、AI学習目的のボットを個別に指定してアクセスを管理します。

以下の表は、従来の検索エンジンボットとAIボットの主な違いをまとめたものです。

| 項目 | 検索エンジンボット | AIボット |

|---|---|---|

| 主な目的 | 検索インデックスの構築 | AI学習データの収集 |

| 代表的なUser-Agent | Googlebot、Bingbot | GPTBot、ClaudeBot |

| アクセス頻度 | 定期的なクロール | 大量・高頻度の傾向あり |

| 制御方法 | robots.txt、メタタグ | robots.txt、メタタグ、HTTP応答ヘッダー |

このように目的やアクセスパターンが異なるため、従来の設定だけではAIボットを十分に制御できない場合があります。

AIボットディレクティブが必要な背景

生成AIの急速な発展により、Webコンテンツが無断でAIの学習データとして収集されるリスクが高まっていることが、AIボットディレクティブの必要性を押し上げています。特に、オリジナルの記事や調査データ、クリエイティブなコンテンツを多く保有するサイトにとっては、知的財産保護の観点からも重要なテーマとなっています。

また、AIボットの大量アクセスによってサーバー負荷が増大し、一般ユーザーの閲覧体験に悪影響を及ぼすケースも報告されています。AIボットディレクティブを導入することで、こうしたパフォーマンス面の問題を緩和できる可能性もあります。

主なAIボットの種類

AIボットディレクティブを設定するにあたり、制御対象となる主なAIボットを把握しておくことが重要です。以下の表は、代表的なAIボットとその運営元をまとめたものです。

| User-Agent名 | 運営元 | 主な用途 |

|---|---|---|

| GPTBot | OpenAI | GPTモデルの学習データ収集 |

| Google-Extended | Geminiなどの生成AI学習用 | |

| ClaudeBot | Anthropic | Claudeモデルの学習データ収集 |

| Bytespider | ByteDance | AI学習データ収集 |

新しいAIボットは次々と登場するため、定期的にUser-Agent情報を確認し、必要に応じてAIボットディレクティブの設定を更新することが求められます。

AIボットディレクティブは「守る」と「広める」を両立できる仕組みです。まずは対象となるボットの種類を把握するところから始めてみましょう。

AIボットディレクティブの設定方法

robots.txtによるサイト全体の制御

robots.txtはサイト全体やディレクトリ単位でAIボットのアクセスを制御でき、AIボットディレクティブの中でも最も基本的な設定方法です。設定はサイトのルートディレクトリに配置するrobots.txtファイルに、対象のUser-Agentとクロール許可・拒否のルールを記述する形式で行います。

たとえば、GPTBotのクロールをサイト全体で拒否する場合は「User-agent: GPTBot」の下に「Disallow: /」と記述します。特定のディレクトリだけ許可する場合は「Allow: /public/」のように指定します。複数のAIボットに対して個別にルールを設定することも可能です。

メタタグによるページ単位の制御

ページごとに細かくAIボットディレクティブを設定したい場合は、HTMLのhead要素内にメタタグを記述する方法が有効です。メタタグを使用すれば、特定のページだけAIクローラーのインデックスやコンテンツ収集を拒否するといった柔軟な運用が実現できます。

具体的には、meta要素のname属性にボット名、content属性に「noai」や「noimageai」などの値を指定します。この方法はCMS(コンテンツ管理システム)を利用している場合でも、テンプレートやプラグインを通じて比較的簡単に実装できます。

HTTP応答ヘッダーによる制御

PDF や画像など、HTMLのメタタグを挿入できないコンテンツに対しては、HTTP応答ヘッダーを使ったAIボットディレクティブの設定が有用です。サーバーの設定ファイルやCDN(コンテンツ配信ネットワーク)の管理画面から、X-Robots-Tagヘッダーを付与することでAIボットの挙動を制御できます。

HTTP応答ヘッダーは、メタタグでは対応できないファイル形式のコンテンツも含め、サーバーレベルで包括的にAIボットディレクティブを適用できる方法です。

設定方法の比較と選び方

3つの設定方法にはそれぞれ特徴があります。以下の表を参考に、自社サイトの状況に合った方法を選択してください。

| 設定方法 | 制御の粒度 | 適用対象 | 導入の容易さ |

|---|---|---|---|

| robots.txt | サイト全体・ディレクトリ単位 | 全コンテンツ | 容易 |

| メタタグ | ページ単位 | HTMLページ | やや容易 |

| HTTP応答ヘッダー | ファイル単位 | 全ファイル形式 | やや複雑 |

多くのサイトでは、まずrobots.txtでサイト全体の基本方針を定め、必要に応じてメタタグやHTTP応答ヘッダーで個別の例外設定を行うというアプローチが取られています。

AIボットディレクティブの設定前に確認すべきポイント

- 制御対象とするAIボットのUser-Agent名を特定しているか

- 保護すべきコンテンツの範囲を明確にしているか

- 検索エンジンボットへの影響がないことを確認しているか

- 設定後のアクセスログを定期的にモニタリングする体制があるか

robots.txt、メタタグ、HTTP応答ヘッダーの3つを組み合わせることで、より精密なAIボットディレクティブの運用が可能になります。

AI検索パートナーズでは、

AIに”選ばれる”ための戦略設計から実行まで支援!

AIボットディレクティブの注意点

検索エンジンへの影響を避ける

AIボットディレクティブの設定で最も注意が必要なのは、検索エンジンのクローラーまで誤ってブロックしてしまうケースです。robots.txtの記述でワイルドカードを安易に使用すると、Googlebotなどの検索エンジンボットもクロール対象外になり、検索順位が大幅に低下する可能性があります。

たとえば「User-agent: *」と「Disallow: /」を組み合わせると、すべてのボットのアクセスを拒否してしまいます。AIボットだけを制御したい場合は、必ず対象のUser-Agent名を個別に指定するようにしてください。

AIボットの遵守状況を把握する

robots.txtはあくまでもボットへの「お願い」であり、技術的な強制力を持たないため、すべてのAIボットがAIボットディレクティブに従う保証はありません。信頼性の高い大手プラットフォームのボットは一般的にrobots.txtを尊重しますが、それ以外のボットについては必ずしも準拠しないケースがあります。

そのため、AIボットディレクティブだけに頼るのではなく、サーバーのアクセスログを定期的に確認し、設定に反したアクセスがないかモニタリングすることが重要です。不正なアクセスが確認された場合は、IPアドレスによるブロックやWAF(Webアプリケーションファイアウォール)の活用も検討しましょう。

過度なブロックによる機会損失

すべてのAIボットを一律にブロックすることは、コンテンツ保護の観点では安全に見えますが、AI検索やAIアシスタントを通じた自社コンテンツの露出機会を失うことにもつながります。AI検索結果に自社の情報が表示されなくなると、新たなユーザー層へのリーチが減少するという機会損失が生じる可能性があります。

コンテンツの種類によって、AI学習に利用されてもよいものと保護すべきものを区分し、段階的にAIボットディレクティブを設定することが戦略的なアプローチといえます。

定期的な見直しの重要性

AIの技術やサービスは急速に進化しており、新たなAIボットが次々と登場しています。一度設定したAIボットディレクティブをそのまま放置すると、新しいボットに対応できなくなる恐れがあります。少なくとも四半期に一度は設定内容を見直し、最新のボット情報に基づいてアップデートすることが望ましいとされています。

AIボットディレクティブの運用は「設定して終わり」ではなく、継続的なメンテナンスが不可欠です。

AIボットディレクティブ運用時のチェックリスト

- 検索エンジンボットを誤ってブロックしていないか確認する

- アクセスログでAIボットの挙動を定期的にモニタリングする

- 保護対象と公開対象のコンテンツを区分して設定する

- 四半期に一度は設定内容と新しいボット情報を確認する

保護と露出のバランスを意識しながら、定期的に見直すことがAIボットディレクティブ運用のコツでしょう。

AI検索パートナーズでは、AIに”選ばれる”ための戦略設計から実行まで一気通貫で支援!

AI検索パートナーズでは、AI検索の専門知識と支援実績を持つ専任コンサルタントが、AIに“引用される・選ばれる”ための戦略設計からコンテンツ最適化、効果測定・改善まで一気通貫でご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

AIボットディレクティブの活用戦略

コンテンツ分類による段階的制御

すべてのコンテンツを一律に扱うのではなく、コンテンツの性質に応じてAIボットディレクティブの設定を変えることが効果的です。独自調査データや有料コンテンツは厳格に保護し、一般的な情報発信ページはAIによる参照を許可するという段階的な制御が、戦略的なAIボットディレクティブの運用に有効です。

以下の表は、コンテンツの種類ごとに推奨されるAIボットディレクティブの方針をまとめたものです。

| コンテンツの種類 | 保護の優先度 | 推奨方針 |

|---|---|---|

| 独自調査データ・レポート | 高 | AIボットのアクセスをブロック |

| 有料・会員限定コンテンツ | 高 | AIボットのアクセスをブロック |

| ブランド認知向けの情報記事 | 低 | AIボットのアクセスを許可 |

| 製品・サービス紹介ページ | 中 | 一部のAIボットに許可 |

このように分類を明確にすることで、AIボットディレクティブの設定根拠を組織内で共有しやすくなり、一貫性のある運用が実現できます。

AI検索時代のSEOとの連携

AI検索エンジンがユーザーの情報収集手段として存在感を増す中で、AIボットディレクティブの設定はSEO戦略とも密接に関わっています。AI検索結果に自社コンテンツを表示させたい場合は、該当するAIボットのクロールを許可しつつ、構造化データやFAQスキーマを整備して引用されやすい情報設計を行うことがポイントです。

従来のSEOとAI検索最適化(LLMO/GEO)を組み合わせた統合的なアプローチにより、検索エンジン経由とAI経由の双方からトラフィックを獲得できる可能性が広がります。

組織的な運用体制の構築

AIボットディレクティブの運用は、技術担当者だけでなく、コンテンツ制作者や法務担当者も含めた組織的な取り組みとして進めることが望ましいです。知的財産に関わるコンテンツの特定は法務部門、技術的な設定はエンジニア、コンテンツの露出戦略はマーケティング部門というように、役割を分担して運用する体制が効果的です。

AIボットディレクティブの方針をドキュメント化し、関係者間で共有することで、担当者の変更があっても一貫した運用を維持できます。

AIボットディレクティブ活用戦略のチェックリスト

- コンテンツを種類別に分類し、保護・公開の方針を決定しているか

- AI検索結果への表示を意識した情報設計を行っているか

- 関係部門を含めた運用体制を構築しているか

- AIボットディレクティブの方針を文書化し共有しているか

守るだけでなく「どこに届けるか」を考えることが、AIボットディレクティブを活用する最大のポイントです。

よくある質問

- AIボットディレクティブを設定すると検索順位に影響しますか

-

AIボットディレクティブの設定自体は、通常の検索エンジンボット(Googlebotなど)をブロックしない限り、検索順位に直接影響を与えることはありません。ただし、設定を誤ってすべてのボットを拒否してしまうと、検索インデックスから除外される可能性があるため、対象のUser-Agentを正確に指定することが重要です。

- robots.txtでAIボットをブロックすれば確実にデータ収集を防げますか

-

robots.txtは技術的な強制力を持つ仕組みではなく、あくまでもボットへの「指示」にとどまります。大手プラットフォームが運営するAIボットは一般的にrobots.txtの指示に従いますが、すべてのボットが必ず準拠するとは限りません。アクセスログの定期的な確認やWAFの導入など、複合的な対策を検討することが望ましいです。

- AIボットディレクティブはWordPressなどのCMSでも設定できますか

-

はい、WordPressをはじめとする多くのCMSでAIボットディレクティブを設定できます。robots.txtファイルの編集は管理画面やプラグインを通じて行えるほか、メタタグの追加もテーマのテンプレート編集や専用プラグインで対応可能です。CMSの種類に応じた設定方法を確認のうえ、導入を進めてください。

まとめ

AIボットディレクティブは、生成AI時代において自社コンテンツを守りながら効果的に情報を届けるための重要な仕組みです。robots.txt、メタタグ、HTTP応答ヘッダーの3つの設定方法を目的に応じて使い分けることで、適切な制御が実現できます。

設定にあたっては、検索エンジンボットへの誤った影響を避けること、AIボットの遵守状況を把握すること、そして過度なブロックによる機会損失に注意することが大切です。保護すべきコンテンツと公開してよいコンテンツを明確に区分し、組織的な運用体制を整えましょう。

AIボットディレクティブは一度設定すれば完了するものではなく、定期的な見直しと更新が必要です。AI技術の進化に合わせて柔軟に対応し、コンテンツの保護と露出拡大を両立させる戦略的な運用を継続していくことが求められます。