AI検索エンジンが普及する中で、自社コンテンツがChatGPTやPerplexityなどのLLM(大規模言語モデル)に引用されるかどうかは、Webマーケティングの新たな課題となっています。しかし、従来のSEO対策とは異なり、LLMOの施策効果をどのように測定し、改善すればよいのか分からないという声も少なくありません。そこで注目されているのが、LLMOにおけるA/Bテストの活用です。本記事では、LLMOのA/Bテストの基本的な考え方から、具体的な検証手順、評価指標、そして引用率を高めるための実践的な対策までを徹底的に解説します。AI検索時代の新しいコンテンツ最適化に取り組みたい方は、ぜひ最後までご覧ください。

- LLMOのA/Bテストの基本概念と従来のA/Bテストとの違い

LLMOのA/Bテストとは、AI検索エンジンに引用されやすいコンテンツ構造を検証するための手法であり、従来のクリック率やコンバージョン率とは異なる独自の指標で評価します。

- AI検索で引用率を高めるための具体的な検証手順

テスト設計から実行、効果測定までの一連のプロセスを段階的に整理しており、実務にそのまま活かせる内容です。

- LLMOのA/Bテストで成果を出すための実践的な改善ポイント

構造化データや結論ファーストの文章設計など、AIに選ばれるコンテンツを作るための具体的な改善施策を解説しています。

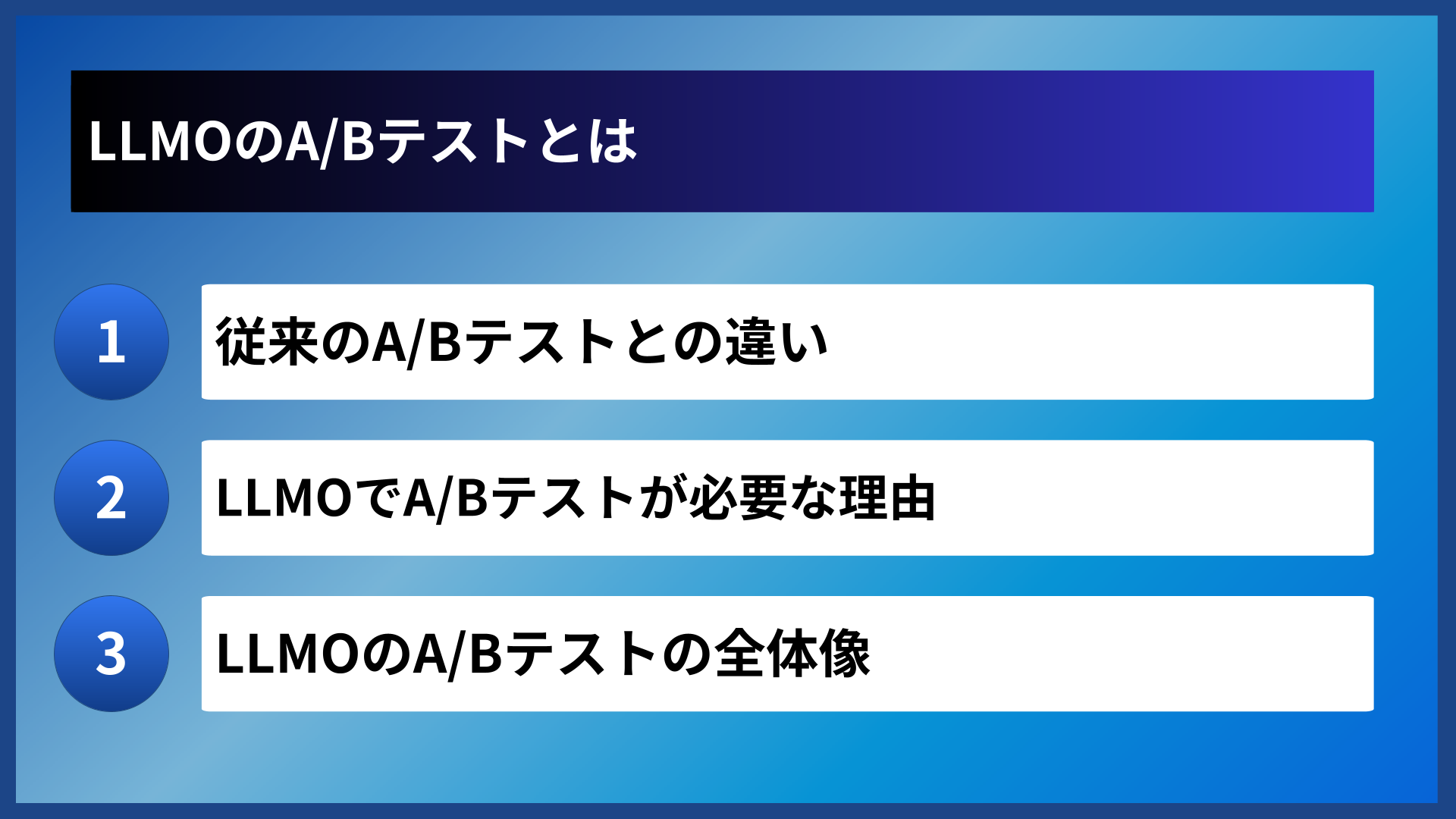

LLMOのA/Bテストとは

従来のA/Bテストとの違い

LLMOのA/Bテストでは、ユーザーの行動データではなく、AIがどのコンテンツを引用するかという「AI側の選択」を検証対象とする点が最大の違いです。従来のA/Bテストではボタンの色やCTAの文言を変えてユーザーの反応を測定しますが、LLMOではコンテンツの構造・文体・情報の提示順序などを変えて、AIの引用挙動の変化を観察します。

また、評価のタイミングにも違いがあります。従来のテストはリアルタイムに近い形で結果を取得できますが、LLMOのテストではAIのクローリング頻度やモデルの更新タイミングに依存するため、検証サイクルが長くなる傾向にあります。

以下の表は、従来のA/BテストとLLMOのA/Bテストの主な違いを整理したものです。

| 比較項目 | 従来のA/Bテスト | LLMOのA/Bテスト |

|---|---|---|

| 検証対象 | ユーザーの行動(クリック、CV) | AIの引用・参照挙動 |

| 主な指標 | CTR、CVR、滞在時間 | 引用率、表示頻度、引用順位 |

| 変更要素 | デザイン、CTA、レイアウト | 文章構造、見出し、構造化データ |

| 結果取得の速度 | 数日〜数週間 | 数週間〜数か月 |

このように、LLMOのA/Bテストは従来とは異なるアプローチが求められるため、専用の評価フレームワークを構築することが重要です。

LLMOでA/Bテストが必要な理由

AI検索の結果は従来の検索結果と異なり、ランキングではなく「引用されるかどうか」の二択に近い構造であるため、わずかなコンテンツの差が大きな結果の違いを生みます。だからこそ、仮説を立てて検証を繰り返すA/Bテストの手法が効果的です。

さらに、LLMの挙動はブラックボックスな部分が多く、どのような要素がAIの引用判断に影響を与えるかが明確になっていません。体系的にテストを行うことで、自社のコンテンツ領域における引用の法則性を発見できる可能性があります。

LLMOのA/Bテストの全体像

LLMOのA/Bテストは、大きく「仮説設定」「テスト設計」「実行・観測」「評価・改善」の4つのフェーズで構成されます。各フェーズで適切な手順を踏むことで、再現性のある検証が可能になります。

テスト全体の流れをあらかじめ設計しておくことで、属人的な判断を排除し、チーム全体で継続的な改善サイクルを回せるようになります。次のセクションでは、具体的な検証手順について詳しく解説していきます。

LLMOのA/Bテストは「AIに選ばれるかどうか」を検証する新しい手法です。従来のテストとは指標もアプローチも異なるので、まず全体像を理解するところから始めましょう。

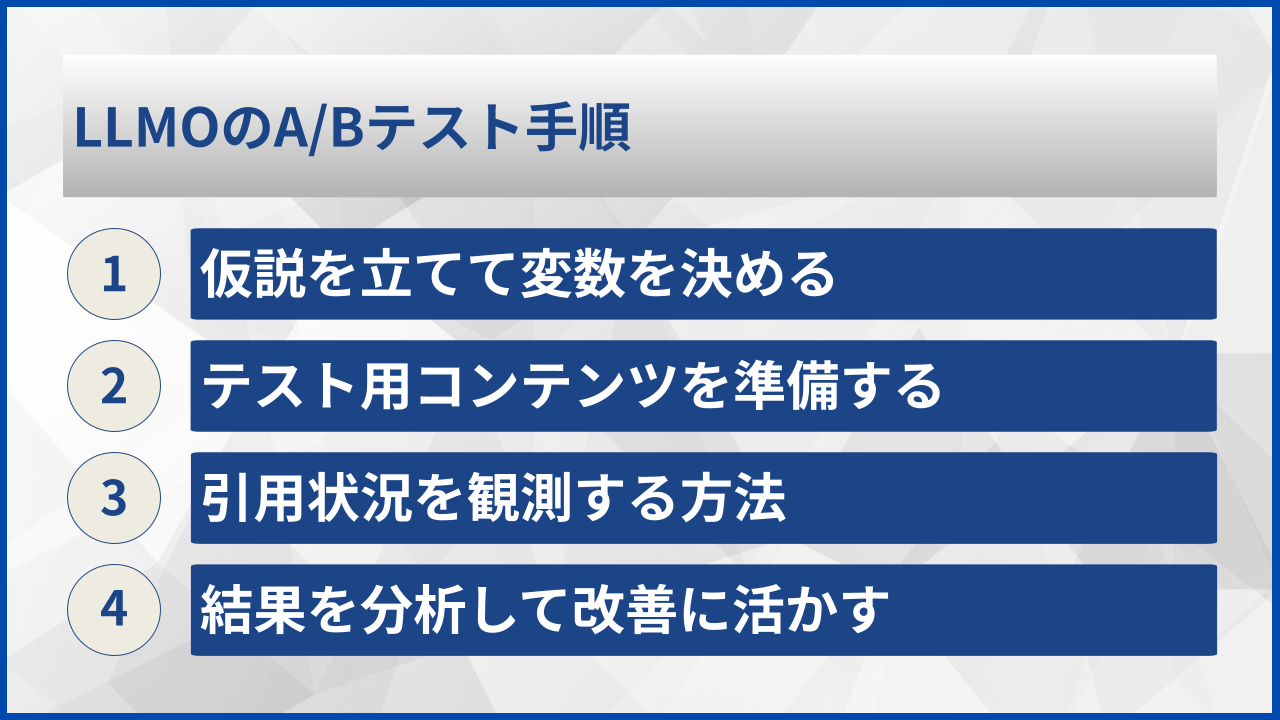

LLMOのA/Bテスト手順

仮説を立てて変数を決める

最初のステップは、AI検索での引用率に影響を与えると考えられる要素について仮説を立てることです。たとえば、「結論を冒頭に配置すれば引用率が上がるのではないか」「FAQ構造化データを追加すればAIが参照しやすくなるのではないか」といった仮説が考えられます。

A/Bテストでは一度に変更する変数を1つに絞ることで、どの要素が引用率に影響を与えたのかを正確に特定できます。複数の変更を同時に行うと因果関係が不明確になるため注意が必要です。

以下は、LLMOのA/Bテストで検証されることが多い変数の一覧です。

| 変数カテゴリ | 具体的な変更内容 | 検証の目的 |

|---|---|---|

| 文章構造 | 結論ファースト vs 起承転結 | AIの引用箇所の選定傾向を確認 |

| 見出し設計 | 質問形式 vs 宣言形式 | 見出し形式による引用率の違い |

| 構造化データ | FAQ追加 vs FAQ無し | 構造化マークアップの影響度を測定 |

| 情報の具体性 | 数値データ有り vs 定性表現のみ | 定量情報がAI引用に与える影響を確認 |

仮説と変数を明確にすることで、テスト後の分析がスムーズに進みます。

テスト用コンテンツを準備する

仮説が決まったら、テスト対象となるコンテンツのA版(現行版)とB版(変更版)を作成します。この際、変更箇所以外の条件をできる限り揃えることが重要です。テーマ、文字数、公開タイミング、対象キーワードなどを統一することで、結果の信頼性が高まります。

コンテンツのURL構造やドメインの権威性などの外的要因も可能な限り同条件に揃えることで、テスト結果の精度が向上します。同一ドメイン内の別ページで検証を行う方法や、同一ページの時系列での比較方法などが考えられます。

引用状況を観測する方法

テスト用コンテンツを公開したら、AI検索エンジンでの引用状況を定期的に観測します。具体的には、対象キーワードに関連するプロンプトをChatGPTやPerplexityに入力し、回答文中に自社コンテンツが引用されているかどうかを確認します。

観測は1回だけでなく、同じプロンプトを複数回・複数日にわたって実行することが望ましいとされています。LLMの回答はリクエストごとに若干異なる場合があるため、サンプル数を確保して傾向を把握することが大切です。

LLMOのA/Bテストを実施する際のチェックリスト

- 仮説と検証する変数を1つに絞っているか

- A版とB版で変更箇所以外の条件を揃えているか

- 観測用のプロンプトを複数パターン用意しているか

- 十分なサンプル数と観測期間を設定しているか

結果を分析して改善に活かす

観測データが集まったら、A版とB版の引用率や引用箇所の傾向を比較分析します。単純な引用回数だけでなく、引用された文章のどの部分が選ばれたか、回答文中での表示位置はどうだったかなども確認すると、より深いインサイトが得られます。

分析結果をもとに、効果が高かった要素を他のコンテンツにも展開し、効果が低かった要素については新たな仮説を立てて再テストを行います。このPDCAサイクルを継続的に回すことが、LLMOのA/Bテストの本質です。

LLMOのA/Bテストは「仮説→実行→観測→改善」のサイクルを回すことが重要です。一度に変える変数は1つに絞り、正確な因果関係を把握しましょう。

AI検索パートナーズでは、

AIに”選ばれる”ための戦略設計から実行まで支援!

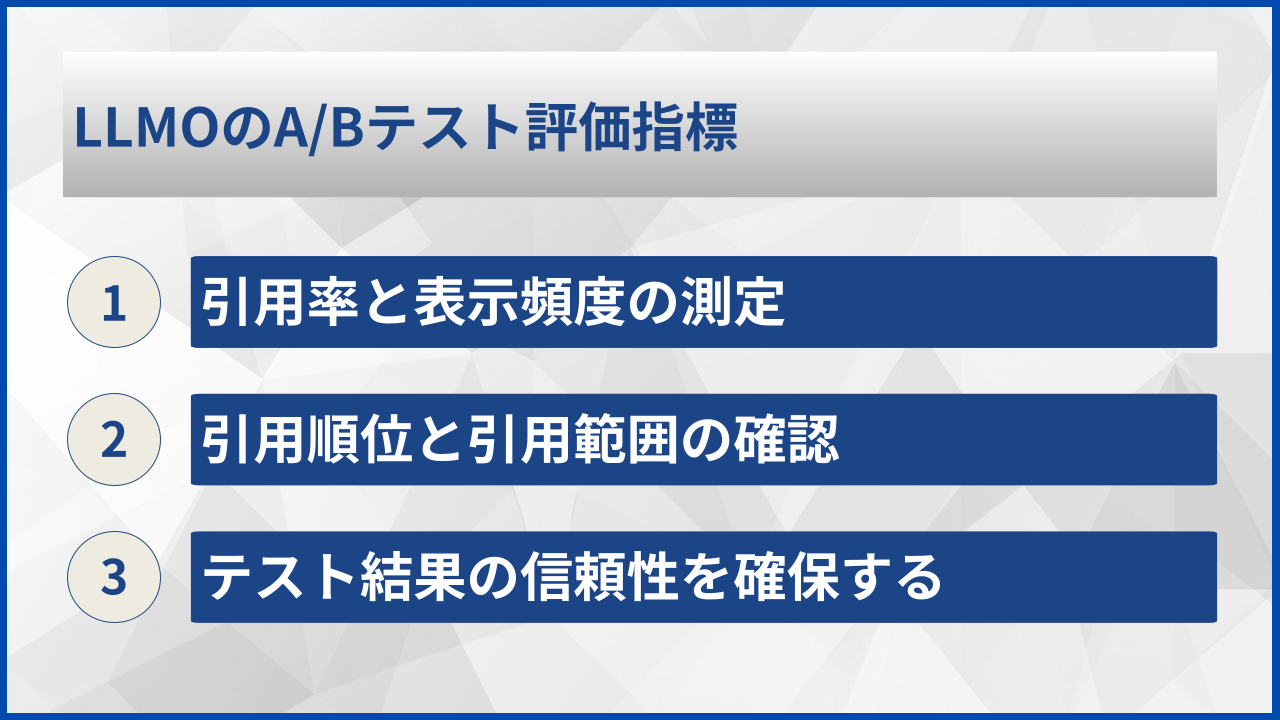

LLMOのA/Bテスト評価指標

引用率と表示頻度の測定

LLMOのA/Bテストにおける最も基本的な指標は「引用率」であり、特定のプロンプトに対してAIが自社コンテンツを引用した回数の割合を示します。たとえば、同じプロンプトを20回入力して5回引用された場合、引用率は25%となります。

表示頻度は、一定期間内にどれだけの頻度で自社コンテンツが引用されたかを時系列で追う指標です。施策前後の変化を比較することで、コンテンツ改善の効果を可視化できます。

引用順位と引用範囲の確認

AIの回答文中で自社コンテンツが何番目に引用されているか(引用順位)も重要な指標です。Perplexityのように出典をリスト表示するAI検索エンジンでは、上位に表示されるほどユーザーの目に留まりやすいと考えられます。

引用範囲については、コンテンツのどの部分が引用されたかを記録することで、AIが特に重視する情報の傾向を把握できます。見出し直下の結論文が引用されやすいのか、リスト形式の情報が選ばれやすいのかなど、具体的なパターンを分析しましょう。

以下は、LLMOのA/Bテストで使用する主な評価指標をまとめた表です。

| 評価指標 | 概要 | 測定方法 |

|---|---|---|

| 引用率 | プロンプト入力に対して引用された割合 | 同一プロンプトの複数回実行で計測 |

| 表示頻度 | 一定期間内の引用回数 | 定期的なモニタリングで記録 |

| 引用順位 | 回答内での引用表示の位置 | 出典リストの掲載順を確認 |

| 引用範囲 | 引用されたコンテンツの具体的な箇所 | 回答文と元コンテンツの照合 |

これらの指標を組み合わせることで、LLMOのA/Bテストの効果を多面的に評価できます。

テスト結果の信頼性を確保する

LLMOのA/Bテストでは、LLMの回答が毎回同一ではないという特性を考慮する必要があります。そのため、1つのプロンプトに対して十分な回数の観測を行い、統計的に有意な差があるかどうかを判断することが大切です。

また、AI検索エンジンのモデルアップデートや学習データの更新により、テスト期間中に外的条件が変化する可能性もあります。テスト期間を区切り、外的要因の影響を記録に残しておくことで、結果の解釈精度を高めることができます。

テスト結果の信頼性を高めるためのチェックリスト

- 1つのプロンプトにつき最低10回以上の観測を行っているか

- テスト期間中のAIモデルのアップデート情報を記録しているか

- 複数のAI検索エンジンで横断的に検証しているか

- 結果の偏りを排除するため、異なる時間帯にも観測しているか

評価指標は引用率だけでなく、引用順位や範囲も含めて多角的に分析することが成功のカギです。十分なサンプル数を確保して、信頼性の高いデータを集めましょう。

AI検索パートナーズでは、AIに”選ばれる”ための戦略設計から実行まで一気通貫で支援!

AI検索パートナーズでは、AI検索の専門知識と支援実績を持つ専任コンサルタントが、AIに“引用される・選ばれる”ための戦略設計からコンテンツ最適化、効果測定・改善まで一気通貫でご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

LLMOのA/Bテスト改善策

結論ファーストの文章設計

AIが回答を生成する際には、コンテンツの冒頭や見出し直下に配置された結論的な文章が引用されやすい傾向があると言われています。そのため、各セクションの冒頭に「この段落で伝えたいこと」を端的にまとめた一文を配置する構成が有効です。

結論ファーストの文章設計は、LLMOだけでなく、読者にとっての可読性向上やSEO面でのユーザー満足度向上にも寄与します。A/Bテストでは、結論ファースト版と従来の起承転結版を比較して、引用率の差を検証するアプローチが考えられます。

構造化データの活用方法

FAQ構造化データやHowTo構造化データをページに実装すると、AIがコンテンツの内容を正確に理解しやすくなります。特にFAQスキーマは、質問と回答のペアを明示的にマークアップできるため、AIが特定の質問に対する回答を引用する際の参考情報として活用される可能性があります。

構造化データを追加したページと追加していないページでLLMOのA/Bテストを行い、引用率の変化を比較することで、マークアップの効果を定量的に評価できます。

以下は、LLMOのA/Bテストで検証すべき改善施策とその期待効果をまとめた表です。

| 改善施策 | 内容 | 期待される効果 |

|---|---|---|

| 結論ファースト化 | 見出し直下に結論文を配置 | AIの引用箇所として選ばれやすくなる |

| FAQ構造化データ追加 | 質問と回答のスキーマを実装 | AIの質問応答での参照率向上 |

| 定量情報の充実 | 数値データや統計を追加 | AIが信頼性の高い情報源として認識 |

| 明確な定義文の追加 | 専門用語に対する簡潔な定義文 | AIが定義を引用する際に選ばれやすい |

これらの施策を一つずつA/Bテストで検証し、効果の大きいものから優先的に横展開していくことが効率的な改善アプローチです。

定量情報と専門性の強化

AIは回答を生成する際、信頼性の高い情報源を優先的に引用する傾向があるとされています。コンテンツに具体的な数値データ、調査結果の引用、専門家の知見などを含めることで、AIからの評価が高まる可能性があります。

E-E-A-T(経験・専門性・権威性・信頼性)を意識したコンテンツ設計は、SEOだけでなくLLMOにおいても引用率向上につながる重要な要素です。テストでは、定性的な表現のみのページと、定量データを豊富に含むページを比較して効果を確認しましょう。

継続的なテスト運用のコツ

LLMOのA/Bテストは一度実施して終わりではなく、AI検索エンジンのアルゴリズム変化やモデルアップデートに対応するために、継続的に実施することが求められます。テスト結果を蓄積し、自社コンテンツ領域における引用パターンのデータベースを構築していくことが理想的です。

また、テスト運用を効率化するために、観測プロセスの一部を自動化するツールの導入も検討に値します。プロンプトの自動入力や回答の記録・分析を仕組み化することで、少ないリソースでも高頻度のテストが可能になります。

LLMOのA/Bテスト改善を継続するためのチェックリスト

- テスト結果を一元管理するドキュメントを用意しているか

- 効果が確認された施策を他のページにも展開しているか

- AIモデルの更新情報を定期的にチェックしているか

- 観測プロセスの一部を自動化する仕組みを検討しているか

改善策は「結論ファースト」「構造化データ」「定量情報」の3つが柱になります。一つずつテストして効果を確認し、勝ちパターンを蓄積していくのがポイントですよ。

LLMOのA/Bテスト注意点

AIの回答揺れへの対処法

LLMは同じプロンプトに対しても、リクエストのたびに異なる回答を返すことがあります。これは「回答揺れ」と呼ばれ、LLMOのA/Bテストにおいて結果のばらつきを生む要因になります。回答揺れを考慮せずに少ないサンプル数で判断すると、誤った結論に至るリスクがあります。

回答揺れの影響を軽減するためには、1つのプロンプトに対して最低でも10回以上の観測を行い、引用率を割合として把握することが推奨されます。

テスト期間の設定ポイント

LLMOのA/Bテストでは、AIのクローリング頻度やインデックス更新のタイミングを考慮してテスト期間を設定する必要があります。コンテンツを公開してすぐにAIが最新情報を参照するとは限らないため、短すぎるテスト期間では正確な結果が得られない場合があります。

一般的には、最低でも2〜4週間のテスト期間を設けることが望ましいとされています。また、テスト期間中にAIモデルの大規模アップデートがあった場合は、その影響を考慮して結果を解釈する必要があります。

SEOとの両立を意識する

LLMOのA/Bテストに注力するあまり、従来のSEOに悪影響を及ぼすコンテンツ変更を行わないよう注意が必要です。AI検索での引用率を高めようとして、極端に短い文章構成にしたり、キーワードの自然な配置を崩したりすると、検索エンジンからの評価が下がる可能性があります。

理想的には、SEOとLLMOの両方にプラスに働くコンテンツ改善を目指すことが重要です。結論ファーストの構成や構造化データの活用は、SEOとLLMOの双方に好影響を与える施策として知られています。

AIの回答揺れやテスト期間の設定は見落としがちなポイントです。SEOとの両立も忘れずに、バランスの取れたテスト運用を心がけてみてください。

よくある質問

LLMOのA/Bテストに関して、多くの方が疑問に感じるポイントをQ&A形式で整理しました。

- LLMOのA/Bテストにはどのくらいの期間が必要ですか?

-

一般的には、最低2〜4週間の観測期間を設けることが望ましいとされています。AIのクローリング頻度やモデルの更新タイミングに影響されるため、従来のA/Bテストよりも長めの期間を想定しておくと安心です。

- LLMOのA/Bテストで使える無料のツールはありますか?

-

現時点では、LLMOのA/Bテストに特化した無料ツールは限られています。ただし、ChatGPTやPerplexityの無料版を活用して手動で引用状況を観測する方法で、基本的な検証を始めることは可能です。観測データの記録にはスプレッドシートなどを活用すると効率的です。

- LLMOのA/BテストはSEOに悪影響を与えませんか?

-

結論ファーストの構成や構造化データの追加といったLLMO施策は、SEOにもプラスに働くケースが多いです。ただし、AI引用のみを意識して極端にコンテンツの質や文字数を削ってしまうと、SEO評価に悪影響を及ぼす可能性があるため、両立を意識した改善を行うことが大切です。

- LLMOのA/Bテストはどのようなコンテンツで実施すべきですか?

-

まずは、自社の主要キーワードに関連するコンテンツや、すでにSEOで上位表示されているページから着手するのが効果的です。検索ボリュームがあり、AI検索でも質問されやすいテーマのコンテンツが優先度の高い候補となります。

まとめ

LLMOのA/Bテストは、AI検索時代において自社コンテンツの引用率を高めるための有効な検証手法です。従来のA/Bテストとは評価指標やテスト設計のアプローチが異なり、AIの引用挙動を観測するという新しい視点が求められます。

効果的なLLMOのA/Bテストを実施するためには、仮説を明確にし、変数を1つに絞り、十分なサンプル数で観測を行うことが重要です。結論ファーストの文章設計、構造化データの活用、定量情報の充実といった改善策を一つずつ検証し、効果の大きい施策から横展開していきましょう。

AI検索の進化は今後も続くと予想されます。LLMOのA/Bテストを継続的に実施し、自社ならではの「AIに選ばれるコンテンツ」のパターンを蓄積していくことが、長期的な競争優位につながるでしょう。