LLM(大規模言語モデル)は、ChatGPTをはじめとする生成AIの中核を担う技術として急速に注目を集めています。しかし「LLMの仕組みがよくわからない」「従来のAIと何が違うのか」と疑問を持つ方も多いのではないでしょうか。LLMは膨大なテキストデータを学習し、人間のような自然な文章を生成できる人工知能モデルです。本記事では、LLMの基本的な仕組みから主要な種類、ビジネスでの活用方法まで、初心者にもわかりやすく徹底解説します。AI技術の理解を深め、業務への活用を検討する際の参考としてお役立てください。

- LLMの仕組みと基本的な動作原理

LLMはTransformerアーキテクチャと大量のテキストデータによる事前学習を基盤とし、次の単語を予測する仕組みで自然な文章を生成します。

- 代表的なLLMの種類と特徴の違い

GPTシリーズやLLaMA、CLAUDEなど主要なLLMにはそれぞれ異なる特徴があり、用途に応じて使い分けることが重要です。

- LLMのビジネス活用と今後の可能性

文章生成・要約・翻訳・コード生成など多彩なタスクに対応でき、業務効率化やサービス改善に大きな可能性を持っています。

LLMの仕組みを理解する

Transformerとは何か

Transformerとは、2017年にGoogleの研究チームが発表した深層学習モデルのアーキテクチャであり、現在のLLMの仕組みの土台となっている技術です。従来の自然言語処理では、文章を先頭から順番に処理する「再帰型ニューラルネットワーク(RNN)」が主流でした。しかしRNNは長い文章になると前半の情報を忘れやすく、処理速度にも限界がありました。

Transformerは「自己注意機構(Self-Attention)」という仕組みを採用しています。これにより、文章中のすべての単語同士の関係性を同時に計算でき、文脈を高い精度で把握できます。たとえば「彼は銀行に行った」という文の「銀行」が金融機関なのか川の土手なのかを、前後の文脈から正確に判断できるのがこの仕組みの強みです。

事前学習の流れ

LLMの仕組みにおいて、事前学習は非常に重要なプロセスです。事前学習では、インターネット上の膨大なテキストデータ(書籍、Webページ、論文など)を使い、モデルが言語の構造やパターンを自律的に学びます。

具体的には「次に来る単語を予測する」というタスクを繰り返すことで、文法・語彙・文脈の理解力を獲得していきます。たとえば「今日の天気は」という入力に対して「晴れ」「曇り」などの単語が高い確率で続くことを、大量のデータから統計的に学習します。この過程で数千億から数兆の「パラメータ」と呼ばれる数値が調整され、言語モデルとしての精度が高まります。

ファインチューニングの役割

事前学習だけでは、LLMは汎用的な言語知識を持つにとどまります。特定の用途で高い精度を発揮するには「ファインチューニング(微調整)」と呼ばれる追加学習が必要です。

ファインチューニングでは、質問と回答のペアや人間によるフィードバックデータを使い、LLMの出力品質を目的に合わせて向上させます。たとえばカスタマーサポート用途であれば、問い合わせと適切な回答のデータセットを使って学習させることで、より的確な応答が可能になります。近年は「RLHF(人間のフィードバックによる強化学習)」と呼ばれる手法も広く活用されており、人間の好みに合った自然な回答を生成する能力が飛躍的に向上しています。

LLMの仕組みを理解するうえで押さえておきたいポイントを以下にまとめます。

| プロセス | 目的 | 使用データ |

|---|---|---|

| 事前学習 | 汎用的な言語理解の獲得 | 大規模テキスト(Web、書籍など) |

| ファインチューニング | 特定タスクへの最適化 | タスク固有のデータセット |

| RLHF | 人間の好みに合わせた出力調整 | 人間によるフィードバック |

このように、LLMは段階的な学習プロセスを経て高い言語処理能力を実現しています。

LLMの仕組みは「大量のデータで学び、段階的に精度を上げる」という流れで成り立っているんです。まずはこの全体像を把握しておきましょう。

LLMの主な種類を比較する

GPTシリーズの特徴

GPT(Generative Pre-trained Transformer)は、OpenAIが開発したLLMシリーズで、ChatGPTの基盤技術として広く知られています。GPT-3.5やGPT-4といったバージョンがあり、バージョンが上がるごとにパラメータ数や推論精度が向上してきました。

GPTシリーズは「テキスト生成」に特化したLLMの仕組みを持ち、文章作成・要約・翻訳・コード生成など幅広いタスクに対応できる汎用性の高さが特徴です。API経由での利用も可能なため、さまざまなアプリケーションに組み込みやすい点もビジネス活用のメリットと言えるでしょう。

オープンソース系LLM

近年はオープンソースで公開されるLLMも増えており、代表的なものにMetaのLLaMAシリーズやMistralなどがあります。オープンソース系LLMは、モデルの重みやコードが公開されており、自社環境でカスタマイズや運用ができるのが大きな利点です。

オープンソース系のLLMは自社データで独自にファインチューニングできるため、セキュリティやプライバシーを重視する企業に適した選択肢となっています。ただし、運用にはインフラ構築や専門的な技術知識が求められる点には留意が必要です。

日本語対応のLLM

LLMは英語圏のデータで学習されたモデルが多いため、日本語の処理精度にはモデルによって差があります。近年では日本語に特化して学習されたLLMや、日本語データで追加学習を行ったモデルも登場しています。

日本語特有の敬語表現や文法構造に対応したLLMを選ぶことで、ビジネス文書やカスタマーサポートなどの品質が大きく向上します。日本語での利用を前提とする場合は、モデルの日本語対応状況を事前に確認することが重要です。

代表的なLLMの種類と特徴を以下の表で比較します。

| LLMの種類 | 開発元 | 公開形態 | 主な特徴 |

|---|---|---|---|

| GPTシリーズ | OpenAI | API提供(クローズド) | 汎用性が高く幅広いタスクに対応 |

| Claude | Anthropic | API提供(クローズド) | 安全性を重視した設計 |

| Gemini | API提供(クローズド) | マルチモーダル対応 | |

| LLaMA | Meta | オープンソース | 自社環境でのカスタマイズが可能 |

| Mistral | Mistral AI | オープンソース | 軽量ながら高い性能 |

LLMを選定する際は、以下のチェックリストを参考にしてみてください。

LLM選定時のチェックポイント

- 利用目的(文章生成、要約、翻訳など)に合った性能か

- 日本語対応の精度は十分か

- セキュリティ要件(クラウド利用可否、データの取り扱い)を満たすか

- コスト(API利用料、インフラ費用)は予算内か

LLMは種類ごとに強みが異なるので、目的に合ったモデルを選ぶことが成果につながるポイントでしょう。

AI検索パートナーズでは、

AIに”選ばれる”ための戦略設計から実行まで支援!

LLMの仕組みで実現できること

文章生成と要約

LLMの仕組みが最も得意とする分野のひとつが、文章の生成と要約です。メールの下書き、報告書の作成、ブログ記事の執筆など、テキスト作成に関わる多くの業務を効率化できます。

LLMは入力されたプロンプト(指示文)に基づき、文脈に沿った自然な文章を生成できるため、文章作成にかかる時間を大幅に短縮することが期待されます。また、長文のドキュメントやレポートを短い要約にまとめる処理も高い精度で行えます。会議の議事録を自動要約するといった使い方も広がっています。

翻訳と多言語対応

LLMは多言語のテキストデータで学習されているため、高品質な翻訳処理にも対応できます。単純な単語の置き換えではなく、文脈やニュアンスを考慮した自然な翻訳が可能です。

LLMの仕組みを使った翻訳は、従来の機械翻訳に比べて文脈理解力が高く、ビジネス文書や技術文書の翻訳品質が向上すると言われています。海外とのやり取りが多い業務においては、コミュニケーションの効率化に貢献できるでしょう。

プログラムコードの生成

LLMは自然言語だけでなく、プログラミング言語のコード生成にも活用できます。やりたい処理を日本語や英語で説明するだけで、対応するコードを出力してくれます。

プログラミング経験が少ない方でも、LLMの仕組みを活用すれば簡単なスクリプト作成やコードの修正が行えるようになります。エンジニアにとっても、コードレビューやバグの発見、リファクタリングの補助として活用する場面が増えています。

情報抽出と分析

大量のテキストデータから必要な情報を抽出し、分類・分析するタスクもLLMの得意分野です。顧客からの問い合わせ内容を自動分類したり、アンケートの自由回答欄から傾向を把握したりする用途で活用が進んでいます。

LLMは非構造化データであるテキストを構造化された情報に変換する能力に優れており、データ分析の前処理を大幅に効率化できます。従来は人手に頼っていた作業を自動化できるため、分析精度の均一化にもつながります。

LLMで実現できることを用途別に整理すると以下のようになります。

| 用途 | 具体例 | 期待できる効果 |

|---|---|---|

| 文章生成・要約 | メール作成、議事録要約 | 作業時間の短縮 |

| 翻訳 | ビジネス文書の多言語変換 | コミュニケーションの効率化 |

| コード生成 | スクリプト作成、コードレビュー | 開発速度の向上 |

| 情報抽出・分析 | 問い合わせ分類、アンケート分析 | 分析精度の向上と均一化 |

LLMの活用を始める前に確認しておきたいポイントも整理しておきましょう。

LLM活用前の確認ポイント

- LLMの出力結果は必ず人間が確認・検証する運用体制があるか

- 機密情報や個人情報をLLMに入力しないルールが整備されているか

- LLMの出力に対する著作権やライセンスの取り扱いを把握しているか

- ハルシネーション(誤情報の生成)のリスクを組織内で共有しているか

LLMは文章生成からコード作成まで幅広く使えますが、必ず人間がチェックする運用が大前提です。

AI検索パートナーズでは、AIに”選ばれる”ための戦略設計から実行まで一気通貫で支援!

AI検索パートナーズでは、AI検索の専門知識と支援実績を持つ専任コンサルタントが、AIに“引用される・選ばれる”ための戦略設計からコンテンツ最適化、効果測定・改善まで一気通貫でご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

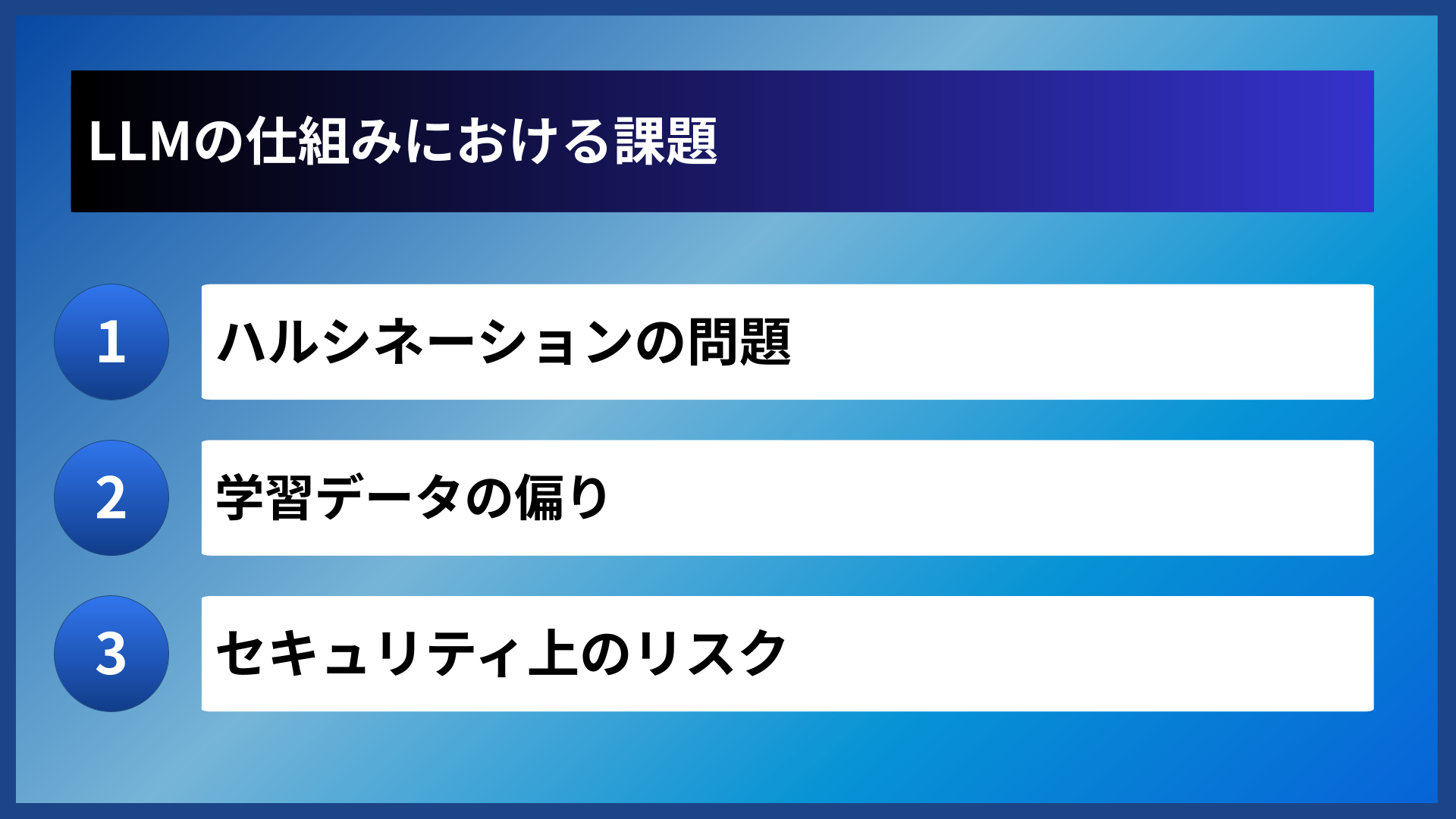

LLMの仕組みにおける課題

ハルシネーションの問題

LLMの仕組み上、最も注意すべき課題のひとつが「ハルシネーション(幻覚)」です。ハルシネーションとは、LLMが事実と異なる情報を、あたかも正しい情報であるかのように自信を持って出力してしまう現象を指します。

LLMは「次に最も確率の高い単語を予測する」仕組みで動作しているため、事実の正確性を保証する機能は本質的に持ち合わせていません。そのため、LLMの出力を鵜呑みにせず、重要な情報については必ず一次情報で裏付けを取るプロセスが欠かせません。

学習データの偏り

LLMが生成する回答の質は、学習に使用されたデータに大きく依存します。学習データに偏りがあれば、出力にもバイアスが反映される可能性があります。

学習データの偏りは、特定のジャンルや言語の情報が過不足することにつながり、公平性や正確性の観点でリスクを生じさせます。たとえば英語中心のデータで学習されたモデルでは、日本語の専門用語や文化的な表現への対応が不十分になる場合があります。LLMの選定時には、学習データの範囲と品質を確認することが望ましいでしょう。

セキュリティ上のリスク

LLMの利用においては、セキュリティとプライバシーに関する配慮も重要です。クラウド型のLLMサービスを利用する場合、入力したデータがサービス提供者側で学習に使用される可能性がある点には注意が必要です。

社内の機密情報や顧客の個人情報をLLMに入力してしまうと、意図せず情報が外部に流出するリスクがあるため、利用ルールの策定が不可欠です。また「プロンプトインジェクション」と呼ばれる、悪意のある入力によってLLMの動作を意図的に操作する攻撃手法も報告されています。LLMを業務で本格的に導入する際は、組織としてのセキュリティポリシーを明確にしておくことが求められます。

LLMの主な課題とその対策を以下にまとめます。

| 課題 | 内容 | 対策 |

|---|---|---|

| ハルシネーション | 事実と異なる情報の生成 | 人間による検証プロセスの導入 |

| 学習データの偏り | 特定分野・言語の情報不足 | 用途に合ったモデルの選定 |

| セキュリティリスク | 入力情報の漏洩リスク | 利用ルールの策定とポリシー整備 |

| プロンプトインジェクション | 悪意ある入力による操作 | 入力フィルタリングの実装 |

課題を踏まえたうえで、安全にLLMを活用するためのチェックリストも確認しておきましょう。

LLM導入時の安全対策チェックリスト

- LLMの出力を最終成果物とせず、必ず人間がレビューする体制を構築しているか

- 機密情報・個人情報の入力を禁止する社内ガイドラインがあるか

- 利用するLLMサービスのデータ取り扱いポリシーを確認したか

- ハルシネーションのリスクを利用者に教育・周知しているか

課題を正しく理解してこそ、LLMを安全に使いこなせるようになるはずです!

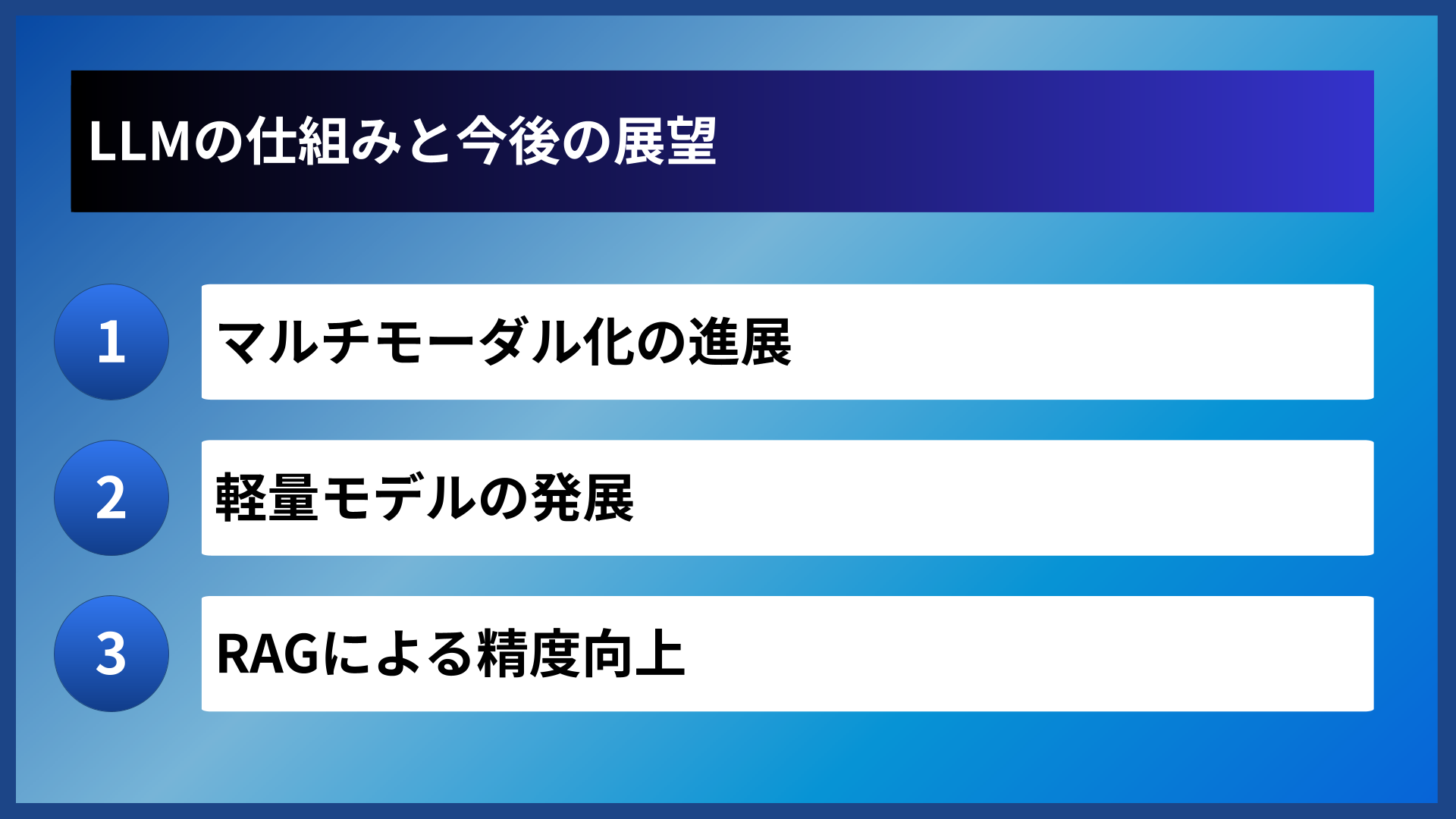

LLMの仕組みと今後の展望

マルチモーダル化の進展

現在のLLMの仕組みはテキスト処理が中心ですが、画像・音声・動画など複数の情報を統合的に処理する「マルチモーダルモデル」への進化が進んでいます。これにより、画像の内容を説明したり、音声入力から文章を生成したりする処理がひとつのモデルで完結するようになります。

マルチモーダル化が進むことで、LLMはテキストだけでなく視覚や聴覚の情報も理解できるようになり、活用の幅が飛躍的に広がると期待されています。ビジネスにおいても、画像付きの資料を読み取って要約する、動画の内容を自動でテキスト化するといった応用が現実的になりつつあります。

軽量モデルの発展

LLMはパラメータ数が大きいほど高い性能を発揮する傾向がありますが、その分、運用には大規模な計算資源とコストが必要になります。こうした課題に対応するため、少ないパラメータ数でも高い性能を実現する軽量モデルの研究が活発に進められています。

軽量LLMが発展すれば、大規模なクラウド環境がなくても手元のデバイスやエッジ環境でLLMを活用できるようになり、コスト面やプライバシー面でのメリットが大きくなります。中小規模の組織でもLLMの恩恵を受けやすくなる未来が近づいていると言えるでしょう。

RAGによる精度向上

RAG(Retrieval-Augmented Generation)は、LLMの仕組みに外部の知識ベースを組み合わせることで、出力の正確性と最新性を高める手法です。LLM単体では学習時点までの情報しか持てませんが、RAGを活用すれば最新の社内データや外部情報を参照したうえで回答を生成できます。

RAGの導入により、LLMのハルシネーションリスクを軽減しながら、より信頼性の高い回答を得られる仕組みが構築できます。社内ナレッジの検索システムやFAQの自動応答など、実用的なユースケースが今後ますます広がっていくことが見込まれます。

LLMの進化はまだまだ続いています。マルチモーダルやRAGなど、最新動向を押さえておくと活用の幅が広がるでしょう。

よくある質問

LLMの仕組みや活用に関して、読者の方からよく寄せられる質問をまとめました。

- LLMとAIの違いは何ですか?

-

AI(人工知能)は機械が知的なタスクを行う技術全般を指す広い概念です。一方、LLMはAIの一種であり、特に自然言語処理に特化した大規模な言語モデルを指します。つまりLLMはAIの中のひとつの技術領域ということになります。

- LLMの仕組みでハルシネーションが起きる理由は何ですか?

-

LLMは「次に最も確率の高い単語を予測する」という仕組みで文章を生成しています。この仕組みは事実の正確性を直接判断するものではないため、文脈上はもっともらしいが事実とは異なる情報を生成してしまうことがあります。これがハルシネーションの主な原因です。

- LLMを業務で活用するにはどのような準備が必要ですか?

-

まず利用目的を明確にし、目的に合ったLLMの種類を選定することが大切です。次に、機密情報の取り扱いルールや出力結果の検証プロセスなど、社内のガイドラインを整備しましょう。小規模なプロジェクトから試験的に導入し、効果を検証しながら段階的に活用範囲を広げていくアプローチが効果的と考えられています。

まとめ

LLMの仕組みは、Transformerアーキテクチャを基盤とした事前学習とファインチューニングによって成り立っています。大量のテキストデータから言語パターンを学び、自然な文章生成や翻訳、コード作成など幅広いタスクを実現できる技術です。

一方で、ハルシネーションや学習データの偏り、セキュリティリスクといった課題も存在します。LLMを安全かつ効果的に活用するには、人間によるレビュー体制の構築や利用ガイドラインの整備が欠かせません。

今後はマルチモーダル化や軽量モデルの発展、RAGの普及によって、LLMの仕組みはさらに進化していくと見込まれています。まずは基本的な仕組みと課題を正しく理解し、自社の業務改善に役立てられるかを検討してみてはいかがでしょうか。

とは?仕組み・種類・できることを初心者にもわかりやすく徹底解説_thumbnail_1776130646977.png)