AI生成コンテンツを活用する場面が急速に広がる一方で、著作権やSEO、法的リスクに関するガイドラインの整備が世界的に進んでいます。2024年以降、EUのAI規制法や日本初のAI関連法の成立など、AI生成コンテンツに関するルールは大きく変化しました。本記事では、AI生成コンテンツに適用されるガイドラインの全体像を、著作権・SEO・リスク対策の観点からわかりやすく解説します。これからAIを活用したコンテンツ制作に取り組む方や、既に運用中の方にも役立つ実践的な情報をお届けします。

- AI生成コンテンツに関する世界各国のガイドラインと規制動向

EU AI規制法や日本のAI関連法など、2024〜2025年に成立した主要な法規制では、AI生成コンテンツの透明性確保と開示義務が共通の柱となっています。

- AI生成コンテンツの著作権リスクと対処法

学習データの著作権侵害や生成物の著作権保護に関する訴訟が世界的に増加しており、利用者側にも法的リスクが生じる可能性があります。

- SEOで評価されるAI生成コンテンツの条件

Googleのガイドラインでは、AI生成かどうかよりもコンテンツの品質とE-E-A-Tが重視されており、人間の専門知識を組み合わせた運用が効果的とされています。

AI生成コンテンツのガイドライン全体像

AI生成コンテンツに関するガイドラインとは、AIが自動的に生成した文章・画像・音声・動画などのコンテンツに対して、透明性の確保、著作権の保護、品質の担保などを求めるルールの総称です。国や地域、プラットフォームごとに異なるルールが存在しますが、共通する方向性として「AIで作った事実を開示すること」「著作権を侵害しないこと」「ユーザーにとって有益な品質を保つこと」の3点が挙げられます。

2024年から2025年にかけて、AI生成コンテンツを取り巻く規制環境は急速に整備されました。以下の表は、主要な規制やガイドラインの概要をまとめたものです。

| 規制・ガイドライン | 地域 | 主な内容 |

|---|---|---|

| EU AI規制法(AI Act) | EU | AI生成コンテンツの機械可読ラベル付与・開示義務 |

| 米国著作権局報告書 | 米国 | AI生成物の著作権保護可否に関する見解 |

| AI関連技術促進法 | 日本 | AI技術の利用促進と基本方針の策定 |

| Google検索品質ガイドライン | 全世界 | E-E-A-Tに基づくコンテンツ品質の評価 |

これらの規制やガイドラインは、それぞれ異なる側面からAI生成コンテンツに制約や基準を設けています。コンテンツ制作者や運営者は、自社の事業範囲に該当するルールを正確に把握したうえで運用体制を整えることが重要です。

EU AI規制法の透明性義務

EU AI規制法(AI Act)の第50条では、生成AIシステムの提供者と利用者に対して、AI生成コンテンツであることを機械可読形式でマーキングし、検出可能な状態にすることを義務づけています。この義務は2026年8月に完全適用される予定で、テキスト・画像・音声・動画すべてが対象です。

特にディープフェイクと呼ばれる、既存の人物を模した加工コンテンツについては、明確なラベリングが求められています。さらに、公共の関心事に関する報道目的のAI生成テキストについても、人間による編集審査を経ていない限り開示が必要とされています。

日本のAI関連法の特徴

2025年5月に成立した日本初のAI関連法は、EUのような詳細な規制ではなく、AI技術の利活用を促進しつつリスクに対応するための基本方針を定めた法律です。日本政府は「AI開発・利用に世界で最もフレンドリーな国」を目指す方針を示しており、規制の厳格さよりもイノベーション促進を重視する姿勢が特徴的です。

ただし、同法には必要に応じてより具体的な規制法を制定する権限を政府に付与する規定も含まれています。今後の運用次第では、透明性義務や開示要件が追加される可能性も考えられます。

米国の州レベル規制動向

米国では連邦レベルの包括的なAI規制法は未成立ですが、カリフォルニア州やニューヨーク州をはじめとする13以上の州で、AI生成コンテンツの開示を義務づける法律が成立しています。対象は政治広告やチャットボット、合成パフォーマー(AI生成の人物)を使用した広告など多岐にわたります。

2025年2月にはマサチューセッツ州で「AI開示法案」が提出され、州内で使用されるすべての生成AIシステムに対して、AI生成であることの明確かつ恒久的な開示を義務づける内容が盛り込まれています。今後、同様の法律が他州にも広がる可能性が指摘されています。

EU・日本・米国でアプローチは異なりますが、「透明性の確保」が共通するキーワードです。自社の事業範囲に合わせてルールを確認しましょう。

AI生成コンテンツの著作権ガイドライン

AI生成コンテンツに関する著作権の問題は、大きく2つに分かれます。1つはAIの学習データに著作物が無断で使用されるリスク、もう1つはAIが生成した成果物に著作権が認められるかという問題です。いずれも世界各国で訴訟や法整備が進んでおり、コンテンツ制作に関わるすべての人が把握しておくべき重要なテーマといえます。

以下の表は、著作権に関するAI生成コンテンツの主なリスク領域を整理したものです。

| リスク領域 | 具体的な内容 | 法的リスク |

|---|---|---|

| 学習データの著作権侵害 | 著作物を無断でAI学習に使用 | 民事上の損害賠償請求・刑事告訴 |

| 生成物の類似性 | 既存著作物に酷似した画像・文章の生成 | 著作権侵害による差止請求 |

| 生成物の著作権保護 | AI生成物に著作権が認められるか | 権利保護が得られない可能性 |

著作権リスクは、AIを「使う側」にも「提供する側」にも発生しうるものです。次のセクションで、それぞれの問題をより具体的に見ていきます。

学習データをめぐる訴訟の増加

2025年8月には日本の大手新聞社3社がAI企業に対して著作権侵害訴訟を提起し、同年11月には日本初のAI生成画像に関する刑事告訴も発生しています。カナダやアメリカでも同様の訴訟が相次いでおり、裁判所がフェアユース(公正使用)の抗弁を退ける判例も出ています。

著作権侵害は民事上の不法行為に分類され、損害賠償請求の対象となります。特に悪質なケースでは刑事責任が追及される可能性もあるため、AIサービスを利用する際は学習データの出所を確認することが重要です。

AI生成物の著作権保護の課題

米国著作権局は2025年1月に公表した報告書の中で、生成AIを使って作成された成果物の著作権保護について検討を進めています。現時点では、人間の創造的な関与が十分に認められない場合、AI生成物に著作権が付与されない可能性が指摘されています。

この問題は、AI生成コンテンツを事業の中核に据える企業にとって大きな経営リスクとなりえます。自社が制作したAI生成コンテンツが著作権で保護されない場合、第三者による無断利用を法的に阻止できない状況が生まれるためです。

AI生成コンテンツの著作権リスクに対応するためのチェックポイントです。

- 利用するAIサービスの学習データの出所・ライセンス状況を確認する

- 生成物が既存の著作物に酷似していないかを公開前にチェックする

- 著作権が認められない可能性を想定した権利保護の代替策を検討する

- 著作権に関する訴訟動向を定期的にモニタリングする

著作権リスクはAIの「使う側」にも発生します。学習データの出所確認と生成物の類似性チェックを習慣化しておくと安心でしょう。

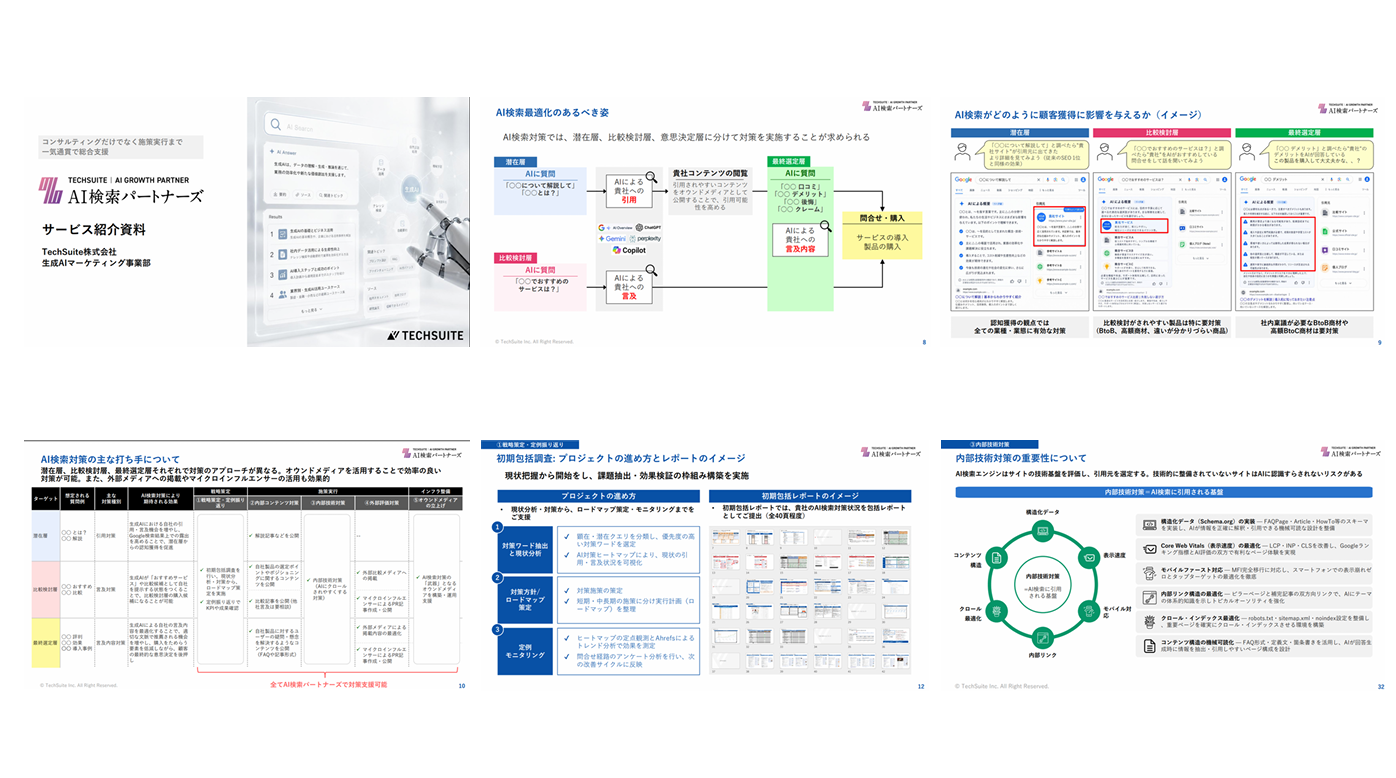

AI検索パートナーズでは、

AIに”選ばれる”ための戦略設計から実行まで支援!

AI生成コンテンツのSEOガイドライン

検索エンジン最適化(SEO)の観点から、AI生成コンテンツにはどのようなガイドラインが適用されるのでしょうか。結論として、Googleはコンテンツの制作方法ではなく品質を重視しており、AI生成であっても高品質であれば検索上位に表示される可能性があります。ただし、人間の専門知識や経験が伴わないAI生成コンテンツは、E-E-A-T(経験・専門性・権威性・信頼性)の不足により順位が低下しやすい傾向があります。

GoogleのE-E-A-T評価基準

Googleのランキングシステムは、コンテンツがAI生成かどうかではなく、E-E-A-T(経験・専門性・権威性・信頼性)を満たす高品質なコンテンツかどうかを評価基準としています。検索順位を操作する目的でAIを使ってコンテンツを大量生成する行為は、スパムポリシー違反と判断される可能性があります。

一方で、ユーザーにとって有益で独自性のあるコンテンツを制作する目的でAIを活用することは、Googleのガイドラインに反しないとされています。重要なのは「誰が」「どのような専門性をもって」「何のために」コンテンツを制作したかという点です。

AI記事が順位低下する原因

AI生成記事が検索順位で低迷する最大の原因は、E-E-A-Tのうち特に「経験」と「信頼性」の要素が不足することにあるとされています。AIは学習データのパターンに基づいて文章を生成するため、独自の体験談や一次情報が含まれにくく、「どこかで見たことがある」ような汎用的な内容になりがちです。

Googleのヘルプフルコンテンツシステムは、検索順位を目的として作られたコンテンツとユーザーのために作られたコンテンツを区別する仕組みです。AI生成コンテンツであっても、人間の専門的な編集や独自の知見が加えられていれば、このシステムによる評価低下を避けられる可能性があります。

人間とAIの協働モデル

SEOで成果を出すためには、AIを「コンテンツの主な制作者」ではなく「リサーチや下書きを支援するパートナー」として活用するアプローチが効果的とされています。専門家が一次情報や文献調査に基づく知見を提供し、AIが構成や文章の効率化を担うという分業が、品質と生産性の両立につながります。

以下の表は、AI単体制作と人間・AI協働制作の特徴を比較したものです。

| 項目 | AI単体制作 | 人間・AI協働制作 |

|---|---|---|

| 制作スピード | 非常に速い | やや速い |

| E-E-A-T充足度 | 低い傾向 | 高い傾向 |

| 独自性・オリジナリティ | 不足しやすい | 確保しやすい |

| 検索順位の安定性 | 低下リスクあり | 比較的安定 |

| 著作権リスク | 確認が不十分になりやすい | 人間の審査で軽減可能 |

AIを活用したコンテンツ制作で検索順位を安定させるためには、文献調査・現場取材・個人の経験という3つの要素を人間が補完することが重要と考えられています。

GoogleはAI生成を禁止していませんが、E-E-A-Tの観点で品質を厳しく評価しています。AIは「支援ツール」として活用するのがポイントです。

AI検索パートナーズでは、AIに”選ばれる”ための戦略設計から実行まで一気通貫で支援!

AI検索パートナーズでは、AI検索の専門知識と支援実績を持つ専任コンサルタントが、AIに“引用される・選ばれる”ための戦略設計からコンテンツ最適化、効果測定・改善まで一気通貫でご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

AI生成コンテンツのリスク対策

AI生成コンテンツを安全かつ効果的に運用するには、規制対応・著作権管理・品質管理・信頼性確保の4つの領域で包括的なリスク対策を講じることが重要です。ここでは、組織として取り組むべき具体的な対策をガイドラインに沿って解説します。

透明性確保の実践方法

AI生成コンテンツのリスク対策として最も基本的なのは、AIを使用した事実を明確に開示し、制作プロセスの透明性を確保することです。どのAIツールを使用したか、人間がどのような編集や審査を行ったかを記録しておくことで、規制対応の証拠としても活用できます。

主要な動画プラットフォームでは、AI生成コンテンツの開示を投稿プロセスに組み込む仕組みが導入されています。開示を怠った場合、コンテンツの公開停止やアカウント停止などのペナルティが科される可能性があるため、各プラットフォームのガイドラインを事前に確認しておくことが大切です。

品質管理体制の構築

AI生成コンテンツの品質を担保するためには、専門知識を持つ人間による事実確認・出典検証・独自性チェックを含む審査プロセスを構築することが効果的です。特に、健康・金融・安全など、ユーザーの生活に大きな影響を与えるYMYL領域のコンテンツについては、より厳格な審査体制が求められます。

品質管理の一環として、AI生成コンテンツが主張する内容に客観的なエビデンスが伴っているか、出典が正確に記載されているかを確認することが重要です。AIはしばしば架空の情報源を生成する「ハルシネーション」を起こすため、出典の実在確認は欠かせません。

AI生成コンテンツを公開する前に確認すべき品質チェックリストです。

- 事実関係が信頼できる情報源で裏付けられているか

- 出典・引用元が実在し、正確に記載されているか

- 既存の著作物に酷似した表現が含まれていないか

- 専門家による内容の正確性チェックを経ているか

- AI使用の開示が適切に記載されているか

技術的な識別手段の活用

電子透かし(ウォーターマーク)やコンテンツ来歴証明(C2PA)などの技術的手段を活用することで、AI生成コンテンツの追跡・識別がより確実に行えるようになっています。電子透かしは生成時にコンテンツに不可視の信号を埋め込む技術で、編集後も検出が可能とされています。

C2PA規格は、コンテンツの作成・編集履歴を暗号学的に証明するマニフェストを付与する仕組みです。ウォーターマークが統計的推測に基づくのに対し、C2PAは暗号学的な証明を提供できるという強みがあります。ただし、悪意のある制作者が自発的にこれらの仕組みを導入する可能性は低いため、プラットフォーム側の対応も不可欠です。

ユーザーの信頼を得る開示方法

調査によると、AI生成であることを開示しても、ユーザーがコンテンツに対して否定的な反応を示すとは限らず、むしろ人間の関与が明確に示されることで信頼度が向上する傾向が報告されています。AI利用の透明性はリスクではなく、信頼構築の機会として捉えることが有効です。

ユーザーの80%以上が何らかの方法でAI生成情報の正確性を検証する行動をとっているとの調査結果もあり、検索エンジンが主な検証手段として利用されています。こうしたユーザー行動を踏まえると、根拠の明示やエビデンスの提示が信頼獲得において重要な役割を果たすといえます。

リスク対策は「守り」だけでなく「信頼構築」にもつながります。透明性の確保と品質管理を両輪で進めていくことが大切です。

AI生成コンテンツのガイドライン対応実践法

ここまで解説してきた規制・著作権・SEO・リスク対策の知識を統合し、実際にAI生成コンテンツを運用するための実践的な方法を紹介します。ガイドラインに準拠したコンテンツ運用は、法的リスクの回避だけでなく、コンテンツの品質向上や検索順位の安定化にも寄与すると考えられます。

制作フローの設計ポイント

AI生成コンテンツのガイドライン対応で最も重要なのは、AIによる生成から人間による審査・編集までを一連のフローとして設計し、各工程の責任者と判断基準を明確にすることです。フローの各段階で品質と規制対応のチェックを行うことで、問題を公開前に発見・修正できます。

具体的には、調査・企画段階では人間の専門家がテーマと方向性を決定し、下書き段階でAIを活用して効率化を図り、編集段階では事実確認・独自性付加・開示記載を人間が行うという分業が効果的です。この流れを組織内のガイドラインとして明文化しておくことで、担当者が変わっても品質を維持しやすくなります。

複数地域への対応方法

複数の国や地域でコンテンツを配信する場合は、最も厳格な規制基準に合わせて運用体制を構築することが効率的なリスク管理方法です。現時点ではEU AI規制法が最も包括的な透明性義務を課しているため、EU基準への対応が他地域のガイドラインもカバーしやすい傾向にあります。

ただし、米国の州レベルの規制は対象分野が異なる場合があるため、事業領域に応じた個別確認も必要です。規制動向は変化が速いため、定期的に最新情報を収集し、運用ガイドラインを更新する仕組みを整えておくことが望ましいでしょう。

AI生成コンテンツの運用体制を整備する際のチェックリストです。

- AIによる下書き → 人間による審査・編集のフローが明文化されているか

- 対象地域の規制要件を一覧化し、定期的に更新しているか

- AI使用の開示方法が各プラットフォームのガイドラインに準拠しているか

- 著作権チェックと品質審査の責任者が明確に定められているか

ガイドライン対応は「一度整備して終わり」ではなく、規制動向に合わせて継続的に更新していく運用が求められます。

よくある質問

- AI生成コンテンツをそのまま公開するとGoogleからペナルティを受けますか

-

AI生成であること自体がペナルティの対象になるわけではありません。ただし、検索順位を操作する目的で大量に低品質なAI生成コンテンツを公開した場合は、Googleのスパムポリシーに抵触する可能性があります。E-E-A-T(経験・専門性・権威性・信頼性)を意識した品質管理が重要です。

- AI生成コンテンツには著作権が認められますか

-

現時点では、人間の創造的な関与が十分に認められない場合、AI生成物に著作権が付与されない可能性が指摘されています。米国著作権局が報告書で検討を進めていますが、各国で判断が異なる状況です。重要なコンテンツについては、人間による創造的な編集や加工を加えることが望ましいと考えられます。

- AI生成コンテンツの開示義務はいつから適用されますか

-

EU AI規制法による透明性義務は2026年8月に完全適用される予定です。米国では州ごとに異なるタイミングで規制が施行されており、日本でも2025年5月にAI関連法が成立しています。事業を展開する地域の規制スケジュールを個別に確認することが重要です。

まとめ

AI生成コンテンツに関するガイドラインは、EU AI規制法の透明性義務、各国の著作権法、Googleの品質評価基準など、複数の領域にまたがって整備が進んでいます。コンテンツ制作者にとって重要なのは、これらのルールを個別に理解し、自社の運用体制に落とし込むことです。

著作権リスクへの対応としては、AIサービスの学習データの出所確認や生成物の類似性チェックが有効な手段となりえます。SEO面では、AIを人間の専門知識を補完するツールとして活用し、E-E-A-Tを満たすコンテンツに仕上げることが検索順位の安定に寄与すると考えられます。

規制環境は今後も変化が続くと予想されるため、最新のガイドライン動向を定期的に確認し、透明性の確保と品質管理を両立させる運用体制を維持していくことが大切です。